Microsoft vysvětluje podivné chování svého chatbota v Bingu

Microsoft se vysvětluje, aby ospravedlnil někdy podivné chování chatbota Bing. Důvodem jsou podle odpovědného týmu dlouhé výměnné pobyty s AI.

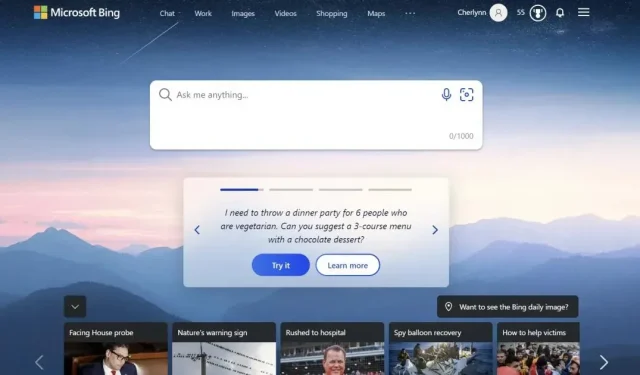

Minulý týden Microsoft spustil svého chatbota založeného na AI pro Bing ve svém prohlížeči Edge, který je od té doby ve zprávách. Ale ne vždy ze správných důvodů . První dojmy byly dobré, velmi dobré, ale uživatelé si začali všímat, že bot Bing rozdával nesprávné informace, nadával uživatelům za plýtvání časem a dokonce vykazoval poněkud „nevyvážené“ chování. V podivném rozhovoru odmítl pustit pásky pro Avatar 2: Waterway a trval na tom, že film ještě nevyšel, protože je stále rok 2022. Robot dokonce uživatele nazval „neinteligentním a tvrdohlavým“, mimochodem, když pokusil Bingovi říct, že se mýlil.

Microsoft se vysvětluje, aby ospravedlnil někdy podivné chování chatbota Bing

Společnost Microsoft dnes zveřejnila blogový příspěvek, který vysvětluje, co se stalo a jak se s takovými problémy vypořádává. Za prvé, společnost se sídlem v Redmondu přiznala, že neplánuje používat Bingovu umělou inteligenci pro „obecné objevování světa a společenskou zábavu“.

Tyto „dlouhé chatovací relace s 15 nebo více otázkami“ mohou srazit systém. „Bing může být opakující se nebo rychlý/pošťuchující, aby poskytl odpovědi, které nemusí být nutně užitečné nebo v souladu s tónem, který chceme,“ vysvětluje společnost. Zjevně je to proto, že robot může „zapomenout“ otázku za otázkou, na kterou se původně snažil odpovědět. Chcete-li tento problém vyřešit, může společnost Microsoft přidat nástroj pro resetování kontextu vyhledávání nebo zahájení od začátku.

Další problém je složitější a zajímavější: „Model se někdy snaží odpovědět nebo myslet stejným tónem, jakým byly položeny otázky, což může někdy vést k nežádoucímu stylu,“ píše Microsoft. To vyžaduje hodně interakce, ale inženýři si myslí, že to mohou vyřešit tím, že uživatelům poskytnou větší kontrolu.

Důvodem jsou podle odpovědného týmu dlouhé výměnné pobyty s AI.

Navzdory těmto obavám jsou testeři podle Microsoftu obecně velmi spokojeni s výsledky vyhledávání AI Bingu. Je však možné dosáhnout lepších výsledků na „vysoce časově omezených datech, jako jsou sportovní výsledky v reálném čase.“ Americký gigant se také snaží vylepšit věcné odpovědi, například pro finanční výkazy, a to vynásobením údajů čtyřnásobkem . Nakonec společnost také „přidá tlačítko, které vám poskytne větší kontrolu, abyste podpořili přesnost nebo kreativitu v odpovědi, v závislosti na vašem požadavku.“

Podpora Bing by ráda poděkovala uživatelům za všechny testy, které provedli a které „pomáhají zlepšit produkt pro všechny“. Inženýři zároveň říkají, že jsou překvapeni, že uživatelé zůstávají na interakci s robotem až dvě hodiny. Uživatelé internetu budou nepochybně muset testovat každou novou iteraci chatbota celý den, vše může být velmi zajímavé.

Subreddit Bing má několik příkladů toho, jak se nový chat Bing vymkl kontrole.

Otevřít chat ve vyhledávání může být špatný nápad!

Zde bráno jako připomenutí, že byla doba, kdy to ve výsledcích ukazoval velký vyhledávač. pic.twitter.com/LiE2HJCV2z

— Vlad (@vladquant) 13. února 2023

Napsat komentář