ChatGPT-opdateringen gør det muligt for dens AI at “se, høre og tale,” ifølge OpenAI

I mandags annoncerede OpenAI en væsentlig opdatering til ChatGPT, der gør det muligt for deres GPT-3.5 og GPT-4 AI-modeller at analysere billeder og reagere på dem som en del af en tekstsamtale. ChatGPT-mobilappen vil også tilføje talesyntesemuligheder, der, når de er parret med dens eksisterende talegenkendelsesfunktioner, vil muliggøre fuldstændig verbale samtaler med AI-assistenten, siger OpenAI.

OpenAI planlægger at udrulle disse funktioner i ChatGPT til Plus- og Enterprise-abonnenter “i løbet af de næste to uger.” Det bemærkes også, at talesyntese kun kommer til iOS og Android, og billedgenkendelse vil være tilgængelig på både webgrænsefladen og mobilapps.

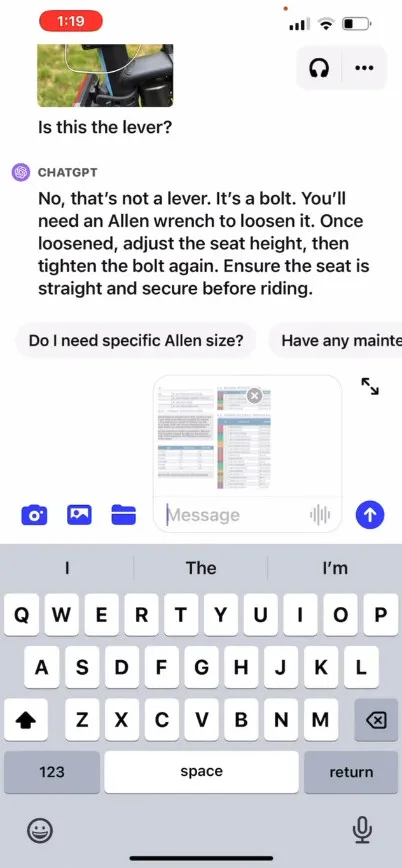

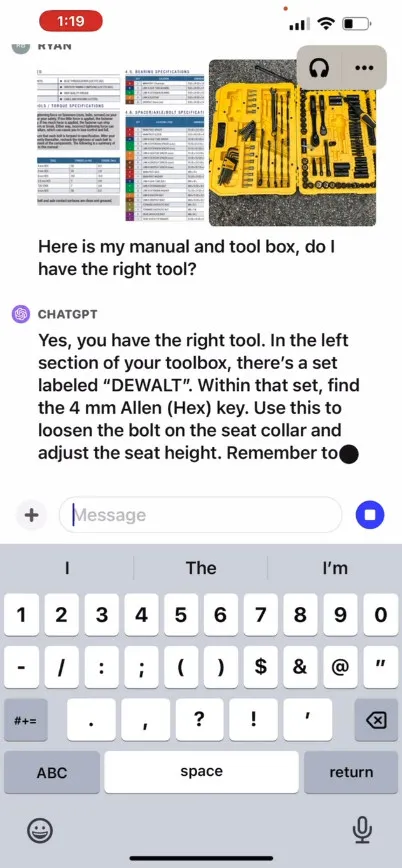

OpenAI siger, at den nye billedgenkendelsesfunktion i ChatGPT lader brugere uploade et eller flere billeder til samtale ved at bruge enten GPT-3.5- eller GPT-4-modellerne. I sit salgsfremmende blogindlæg hævder virksomheden, at funktionen kan bruges til en række forskellige hverdagsapplikationer: fra at finde ud af, hvad der er til aftensmad ved at tage billeder af køleskabet og spisekammeret, til fejlfinding af, hvorfor din grill ikke starter. Det siger også, at brugere kan bruge deres enheds berøringsskærm til at cirkle om dele af billedet, som de gerne vil have ChatGPT til at koncentrere sig om.

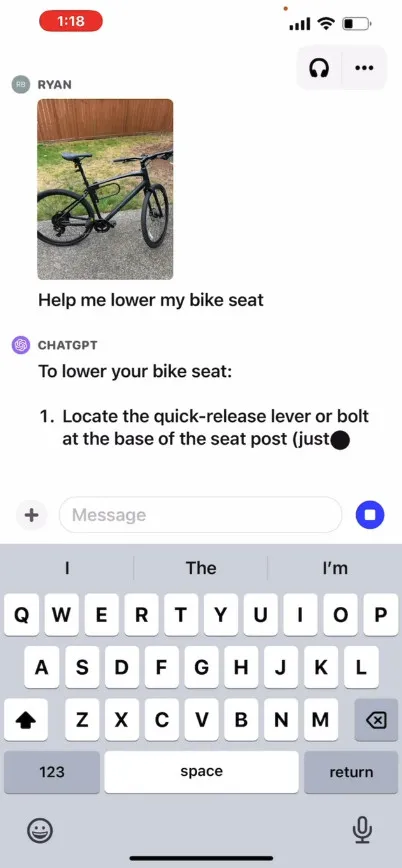

På sit websted leverer OpenAI en salgsfremmende video , der illustrerer en hypotetisk udveksling med ChatGPT, hvor en bruger spørger, hvordan man hæver et cykelsæde, giver billeder samt en instruktionsmanual og et billede af brugerens værktøjskasse. ChatGPT reagerer og rådgiver brugeren om, hvordan processen skal fuldføres. Vi har ikke selv testet denne funktion, så dens effektivitet i den virkelige verden er ukendt.

Så hvordan virker det? OpenAI har ikke frigivet tekniske detaljer om, hvordan GPT-4 eller dens multimodale version, GPT-4V , fungerer under motorhjelmen, men baseret på kendt AI-forskning fra andre (inklusive OpenAI-partneren Microsoft ), transformerer multimodale AI-modeller typisk tekst og billeder til en delt kodningsrum, som gør dem i stand til at behandle forskellige typer data gennem det samme neurale netværk. OpenAI kan bruge CLIP til at bygge bro mellem visuelle data og tekstdata på en måde, der justerer billed- og tekstrepræsentationer i det samme latente rum , en slags vektoriseret net af datarelationer. Denne teknik kunne give ChatGPT mulighed for at foretage kontekstuelle deduktioner på tværs af tekst og billeder, selvom dette er spekulativt fra vores side.

I mellemtiden i lydland giver ChatGPTs nye stemmesyntese-funktion efter sigende mulighed for frem og tilbage talt samtale med ChatGPT, drevet af, hvad OpenAI kalder en “ny tekst-til-tale-model”, selvom tekst-til-tale er blevet løst for en lang tid. Når funktionen rulles ud, siger virksomheden, at brugerne kan engagere sig i funktionen ved at tilmelde sig stemmesamtaler i appens indstillinger og derefter vælge mellem fem forskellige syntetiske stemmer med navne som “Juniper,””Sky,””Cove,””Ember “og “Breeze.” OpenAI siger, at disse stemmer er blevet lavet i samarbejde med professionelle stemmeskuespillere.

OpenAI’s Whisper, et open source-talegenkendelsessystem, vi dækkede i september sidste år, vil fortsætte med at håndtere transskriptionen af brugerens taleinput. Whisper har været integreret med ChatGPT iOS-appen, siden den blev lanceret i maj. OpenAI udgav den tilsvarende dygtige ChatGPT Android-app i juli.

Skriv et svar