Google wird bald explizite Bildersuchergebnisse standardmäßig unkenntlich machen

Google hat eine neue Standardeinstellung für SafeSearch eingeführt, die irgendwo zwischen „Ein“ und „Aus“ liegt und die für die meisten Menschen automatisch explizite Bilder in den Suchergebnissen unkenntlich macht.

In einem Blogbeitrag anlässlich des Safer Internet Day skizzierte Google eine Reihe von Maßnahmen, die das Unternehmen zum „Schutz von Demokratien auf der ganzen Welt“, zum Schutz von Hochrisikopersonen, zur Verbesserung der Passwortverwaltung und zum Schutz von Kreditkartennummern umsetzen will . Hinter einer Reihe kleiner und mittelgroßer Anzeigen verbirgt sich eine spürbare Veränderung in den Suchergebnissen, dem zweiten Schlüsselprodukt von Google nach Anzeigen.

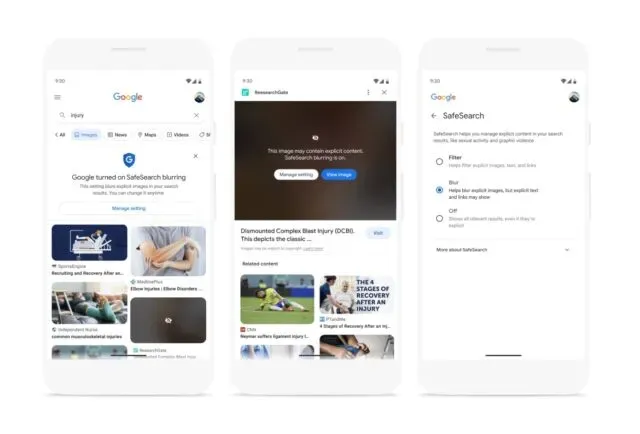

Eine neue Einstellung, die „in den kommenden Monaten“ eingeführt wird, „wird anstößige Bilder unscharf machen, wenn sie in Suchergebnissen erscheinen, wenn die SafeSearch-Filterung nicht aktiviert ist“, schreibt Jen Fitzpatrick von Google, Senior Vice President von Core Systems & Experiences. „Diese Einstellung wird zur neuen Standardeinstellung für Personen, die den SafeSearch-Filter noch nicht aktiviert haben, mit der Möglichkeit, die Einstellung jederzeit zu ändern.“

Das erklärende Bild von Google (siehe oben) zeigt, dass jemand eingeloggt ist und nach „Verletzungs“-Bildern sucht. Aus der Mitteilung geht hervor, dass „Google SafeSearch Blur aktiviert hat“, wodurch „anstößige Bilder in Suchergebnissen unscharf werden“. Ein Beispielbildergebnis – „Complex Explosive Injury in Haste (DCBI)“ von ResearchGate – ist in der Tat ziemlich eindeutig, soweit es um menschliche innere Organe und Muskulatur geht. Google bietet eine abschließende Prüfung an, wenn Sie auf dieses verschwommene Bild klicken: „Dieses Bild enthält möglicherweise anstößige Inhalte.“ SafeSearch-Unschärfe aktiviert.“

Wenn Sie auf „Bild anzeigen“ klicken, werden Sie die Zerbrechlichkeit des Lebens erkennen. Wenn Sie auf „Einstellungen verwalten“ klicken, können Sie aus drei Optionen wählen: Filter (wobei überhaupt keine expliziten Ergebnisse angezeigt werden), Weichzeichnen (wobei Weichzeichnen und Sind Sie sicher, dass Klicks auftreten) und Aus. (wo Sie „alle relevanten Ergebnisse sehen, auch wenn sie explizit sind“).

Benutzer unter 18 Jahren, die angemeldet sind, aktivieren automatisch SafeSearch , das Inhalte wie „Pornografie, Gewalt und Gore“ blockiert. Mit dieser Änderung macht Google anstößige Inhalte automatisch unkenntlich, damit jeder, der Google nutzt, der nicht angemeldet ist, angemeldet bleibt in, und bittet ausdrücklich darum, stattdessen angezeigt zu werden. Auf diese Weise wird verhindert, dass Kinder auf anstößige Bilder zugreifen, und es wird insbesondere auch sichergestellt, dass sich Nutzer bei Google anmelden, wenn sie nach etwas … ganz Bestimmtem suchen. Ein Inkognito-Fenster scheint einfach nicht zu funktionieren.

Google hat SafeSearch im August 2021 standardmäßig für Nutzer unter 18 Jahren aktiviert, da dies vom Kongress gefordert wurde, um Kinder in seinen Diensten, einschließlich der Suche und YouTube, besser zu schützen.

Schreibe einen Kommentar