KI kann jetzt aus Text Musik in CD-Qualität erzeugen, und es wird immer besser

Stellen Sie sich vor, Sie tippen „dramatische Intro-Musik“ und hören eine hochfliegende Symphonie oder schreiben „gruselige Schritte“ und erhalten hochwertige Soundeffekte. Das ist das Versprechen von Stable Audio, einem am Mittwoch von Stability AI angekündigten Text-to-Audio-KI-Modell, das Musik oder Töne aus schriftlichen Beschreibungen synthetisieren kann. Schon bald könnte eine ähnliche Technologie für Musiker eine Herausforderung für ihren Job sein.

Wie Sie sich erinnern, ist Stability AI das Unternehmen, das die Entwicklung von Stable Diffusion finanziert hat , einem Bildsynthesemodell mit latenter Diffusion, das im August 2022 veröffentlicht wurde. Das Unternehmen gab sich nicht damit zufrieden, sich auf die Generierung von Bildern zu beschränken, sondern verzweigte sich durch die Unterstützung von Harmonai auch in den Audiobereich . ein KI-Labor, das im September den Musikgenerator Dance Diffusion auf den Markt brachte .

Nun wollen Stability und Harmonai mit Stable Audio in die kommerzielle KI-Audioproduktion einsteigen. Den Produktionsbeispielen nach zu urteilen , scheint es eine deutliche Verbesserung der Audioqualität im Vergleich zu früheren KI-Audiogeneratoren zu sein, die wir gesehen haben.

Auf seiner Werbeseite stellt Stability Beispiele des KI-Modells in Aktion mit Aufforderungen wie „epische Trailermusik, intensive Tribal-Percussion und Blechbläser“ und „Lofi-Hip-Hop-Beat, melodischer Chillhop 85 BPM“ bereit. Außerdem bietet es Beispiele von Soundeffekten, die mit Stable Audio generiert wurden , wie zum Beispiel ein Flugzeugpilot, der über eine Gegensprechanlage spricht, oder Leute, die sich in einem belebten Restaurant unterhalten.

Um sein Modell zu trainieren, ging Stability eine Partnerschaft mit dem Stock-Musikanbieter AudioSparx ein und lizenzierte einen Datensatz „bestehend aus über 800.000 Audiodateien mit Musik, Soundeffekten und Einzelinstrumenten-Stems sowie entsprechenden Textmetadaten“. Nach der Einspeisung von 19.500 Stunden Audio In das Modell integriert, weiß Stable Audio, wie es bestimmte Geräusche imitiert, die es auf Befehl gehört hat, da die Geräusche in seinem neuronalen Netzwerk mit Textbeschreibungen verknüpft wurden.

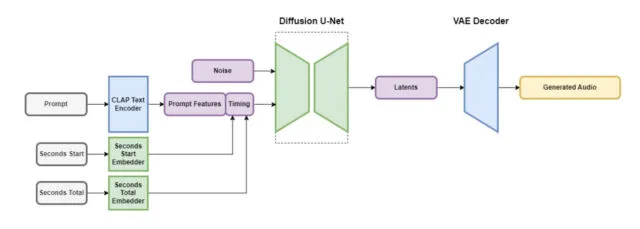

Stable Audio besteht aus mehreren Teilen, die zusammenarbeiten, um schnell individuelles Audio zu erstellen. Ein Teil verkleinert die Audiodatei so, dass ihre wichtigen Funktionen erhalten bleiben und gleichzeitig unnötiges Rauschen entfernt wird. Dadurch lässt sich das System schneller einlernen und neue Audiodaten schneller erstellen. Ein anderer Teil verwendet Text (Metadatenbeschreibungen der Musik und Sounds), um zu steuern, welche Art von Audio erzeugt wird.

Um die Dinge zu beschleunigen, arbeitet die Stable Audio-Architektur mit einer stark vereinfachten, komprimierten Audiodarstellung, um die Inferenzzeit zu verkürzen (die Zeit, die ein maschinelles Lernmodell benötigt, um eine Ausgabe zu generieren, nachdem ihm eine Eingabe gegeben wurde). Laut Stability AI kann Stable Audio auf einer Nvidia A100-GPU 95 Sekunden Stereo-Audio mit einer Abtastrate von 44,1 kHz (oft als „CD-Qualität“ bezeichnet) in weniger als einer Sekunde wiedergeben . Die A100 ist eine leistungsstarke Rechenzentrums-GPU, die für den KI-Einsatz entwickelt wurde und weitaus leistungsfähiger ist als eine typische Desktop-Gaming-GPU.

Wie bereits erwähnt, ist Stable Audio nicht der erste Musikgenerator, der auf latenten Diffusionstechniken basiert. Letzten Dezember haben wir über Riffusion berichtet , eine Hobbyversion einer Audioversion von Stable Diffusion, obwohl die daraus resultierenden Generationen qualitativ weit von den Samples von Stable Audio entfernt waren. Im Januar veröffentlichte Google MusicLM , einen KI-Musikgenerator für 24-kHz-Audio, und Meta brachte im August eine Suite von Open-Source-Audio-Tools (einschließlich eines Text-zu-Musik-Generators) namens AudioCraft auf den Markt. Jetzt legt Stable Diffusion mit 44,1-kHz-Stereo-Audio noch einen drauf.

Stability sagt, dass Stable Audio in einer kostenlosen Stufe und einem monatlichen Pro-Plan für 12 US-Dollar verfügbar sein wird. Mit der kostenlosen Option können Nutzer bis zu 20 Tracks pro Monat mit einer maximalen Länge von jeweils 20 Sekunden generieren. Der Pro-Plan erweitert diese Grenzen und ermöglicht 500 Titelgenerationen pro Monat und Titellängen von bis zu 90 Sekunden. Zukünftige Stability-Versionen werden voraussichtlich Open-Source-Modelle enthalten, die auf der Stable-Audio-Architektur basieren, sowie Trainingscode für diejenigen, die an der Entwicklung von Audio-Generierungsmodellen interessiert sind.

Derzeit sieht es so aus, als ob wir mit Stable Audio angesichts der Audiotreue an der Grenze zu KI-generierter Musik in Produktionsqualität stehen könnten. Werden Musiker glücklich sein, wenn sie durch KI-Modelle ersetzt werden? Wahrscheinlich nicht, wenn uns die Geschichte etwas von KI-Protesten im Bereich der bildenden Künste gezeigt hat . Im Moment kann ein Mensch alles, was KI erzeugen kann, problemlos übertreffen, aber das wird möglicherweise nicht lange der Fall sein. In jedem Fall könnte KI-generiertes Audio zu einem weiteren Werkzeug im Werkzeugkasten der Audioproduktion eines Profis werden.

Schreibe einen Kommentar