OpenAI DALL-E 2 puede renderizar imágenes de cualquier cosa que puedas imaginar

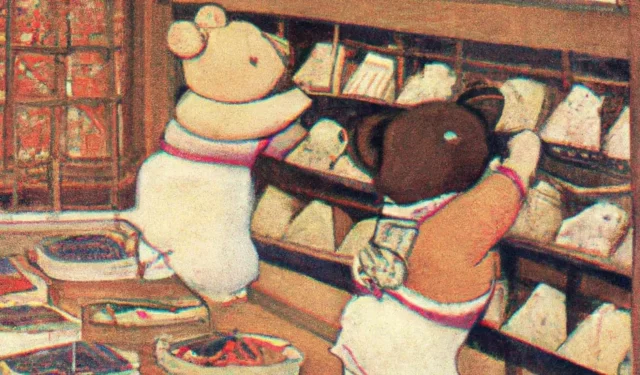

La inteligencia artificial OpenAI DALL-E 2 crea imágenes de dibujos animados basadas en una descripción de texto de su imaginación.

En enero de 2021, el consorcio OpenAI, fundado por Elon Musk y financiado por Microsoft, presentó su proyecto más ambicioso hasta la fecha, el sistema de aprendizaje automático DALL-E. Esta ingeniosa inteligencia artificial multimodal pudo generar imágenes de estilo de dibujos animados basadas solo en palabras clave especificadas por el usuario. Más recientemente, el consorcio presentó una nueva versión de DALL-E con mayor resolución y menor latencia que la anterior.

Inteligencia artificial OpenAI DALL-E 2 crea imágenes de dibujos animados

La primera versión de DALL-E (abreviatura de Dalie y Wall-E) podía generar imágenes y combinar varias imágenes en un collage, sugerir diferentes ángulos e incluso adivinar una serie de elementos de la imagen, como efectos de sombra, a partir de una simple descripción escrita. .

«A diferencia de un renderizador 3D, cuya entrada debe especificarse sin ambigüedades hasta el más mínimo detalle, DALL-E a menudo puede ‘llenar los espacios’ cuando el título implica que la imagen contiene ciertos detalles que no se indican explícitamente», explicó el equipo. IA abierta en 2021.

DALL-E nunca tuvo la intención de ser un producto comercial, por lo que sus capacidades estaban limitadas ya que el equipo de OpenAI solo lo consideró como una herramienta de investigación. También era necesario evitar la situación que tuvo Microsoft con su chatbot Tay y que el sistema no pudiera generar información falsa. Para esta segunda versión, los objetivos siguen siendo los mismos y se ha agregado una marca de agua a la imagen para indicar claramente que fue creada por inteligencia artificial. Además, el sistema ahora prohíbe a los usuarios crear imágenes con nombres propios.

según una descripción textual tomada de tu imaginación

DALL-E 2, que utiliza el sistema de reconocimiento de imágenes OpenAI CLIP, utiliza sus capacidades de generación de imágenes. Los usuarios ahora pueden seleccionar y editar áreas específicas de imágenes existentes, agregar o eliminar elementos junto con sus sombras, fusionar dos imágenes en un collage y crear variaciones de una imagen existente. Las imágenes generadas ahora son cuadrados de 1024px, mientras que los avatares originales eran de 256px. CLIP fue diseñado para resumir el contenido de una imagen de una manera que pueda ser entendida por un humano. El consorcio invirtió el proceso creando una imagen a partir de su descripción.

“DALL-E 1 tomó nuestro enfoque GPT-3 del lenguaje y lo aplicó para crear una imagen: comprimimos las imágenes en un conjunto de palabras y aprendimos a predecir lo que sucedería a continuación”, explicó el investigador Prafulla Dhariwal a The Rod.

A diferencia de la primera versión, con la que todos podían jugar en el sitio de OpenAI, esta versión 2 actualmente solo está disponible para ciertos socios, y ellos mismos están limitados en lo que pueden hacer. Solo unos pocos afortunados pueden usarlo. Tampoco pueden exportar imágenes creadas en una plataforma de terceros, aunque OpenAI planea hacer que las nuevas funciones de DALL-E 2 estén disponibles a través de una API en el futuro. Si aún quieres probar el sistema, puedes apuntarte a la lista de espera .

Deja una respuesta