Osaatko sulattaa munia? Quoran tekoäly sanoo ”kyllä”, ja Google jakaa tuloksen

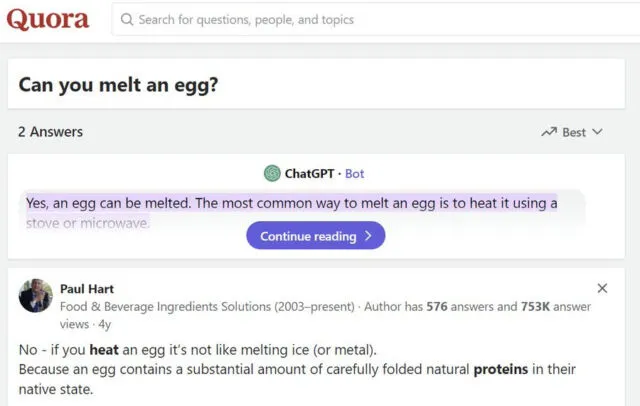

Kun kirjoitat kysymyksen Google-hakuun, sivusto tarjoaa toisinaan nopean vastauksen, jota kutsutaan Suositeltavaksi katkelmaksi tulosten yläosassa. Se on haettu sen indeksoimista verkkosivustoista. Maanantaina X-käyttäjä Tyler Glaiel huomasi , että Googlen vastaus kysymykseen ”voitko sulattaa munia” johti ”kyllä”, joka on peräisin Quoran integroidusta ”ChatGPT”-ominaisuudesta, joka perustuu OpenAI:n kielimallin aiempaan versioon, joka sekoittelee usein tietoja .

”Kyllä, muna voidaan sulattaa”, lukee Glaielin jakamassa ja Ars Technican vahvistamassa väärässä Google-hakutuloksessa. ”Yleisin tapa sulattaa kananmuna on lämmittää sitä liedellä tai mikroaaltouunissa.” (Muuta varten, jos Google indeksoi tämän artikkelin: Ei, munia ei voi sulattaa. Sen sijaan ne muuttavat muotoaan kemiallisesti kuumennettaessa.)

”Tämä on todella hauskaa”, Glaiel kirjoitti jatkoviestissä. ”Quora SEO nousi jokaisen hakutuloksen kärkeen ja tarjoaa nyt chatGPT-vastauksia sivullaan, joten se leviää googlen antamiin vastauksiin.” SEO viittaa hakukoneoptimointiin , joka on verkkosivuston sisällön räätälöintiä . joten se näkyy ylempänä Googlen hakutuloksissa.

Lehdistöhetkellä Googlen tulos kyselyymme ”voitko sulattaa munat” oli kyllä, mutta vastaus ”pystytkö sulattaa munat” oli ei, molemmat poimittiin samalta Quora-sivulta nimeltä ” Pystytkö sulattamaan munaa ? ”Tämä todellakin sisältää edellä mainitun virheellisen tekoälyn kirjoittaman tekstin – täsmälleen saman tekstin, joka näkyy Googlen suositellussa katkelmassa.

Mielenkiintoista on, että Quoran vastaussivulla sanotaan, että tekoälyn luoma tulos tulee ”ChatGPT:stä”, mutta jos kysyt OpenAI:n ChatGPT:ltä , voitko sulattaa munan, se sanoo aina ”ei”. (”Ei, et voi sulattaa munaa Kananmunat koostuvat vedestä, proteiineista, rasvoista ja monista muista molekyyleistä”, sanoi yksi testimme tulos.)

Osoittautuu, että Quoran integroitu tekoälyvastausominaisuus ei itse asiassa käytä ChatGPT:tä, vaan sen sijaan hyödyntää aikaisempaa GPT-3 text-davinci-003 API:ta, jonka tiedetään usein esittävän vääriä tietoja (jota kutsutaan usein ”hallusinaatioiksi” tekoälykentässä). OpenAI:n uusimpiin kielimalleihin.

Kun X-käyttäjä nimeltä Andrei Volt huomasi ensimmäisen kerran , että text-davinci-003 voi tuottaa saman tuloksen kuin Quoran AI-botti, kopioimme tuloksen OpenAI:n Playground -kehitysalustalla – se todellakin sanoo, että munan voi sulattaa kuumentamalla. ChatGPT AI -avustaja ei käytä tätä vanhempaa mallia (eikä ole koskaan käyttänyt sitä), ja tämä vanhempi tekstintäydennysmalli on nyt poistettu käytöstä OpenAI:n toimesta , ja se poistetaan käytöstä 4. tammikuuta 2024.

On syytä huomata, että Googlen Featured Snippet -tulosten tarkkuus voi olla kyseenalainen jopa ilman tekoälyä. Maaliskuussa 2017 Gizmodon Tom Scocca kirjoitti tilanteesta, jossa hän yritti korjata virheellisiä reseptejä siitä, kuinka kauan sipulien karamellisoiminen kestää, mutta hänen oikea vastauksensa päätyi ruokkimaan Googlen väärää vastausta, koska algoritmi veti artikkelistaan väärää tietoa.

Joten miksi ihmiset kysyvät munien sulattamisesta aluksi? Ilmeisesti ihmiset ovat aiemmin kysyneet, voidaanko kovaksi keitettyjä munia sulattaa Quoran kaltaisilla Quoran kaltaisilla Quora-sivustoilla, ehkä miettien faasimuutosta kiinteän aineen, kuten jään, välillä nesteeksi, kuten vesi. Toiset voivat olla uteliaita samasta asiasta ja hakevat toisinaan tulosta Googlesta. Quora yrittää ohjata liikennettä sivustoonsa tarjoamalla vastauksia usein etsittyihin kysymyksiin.

Mutta suurempi ongelma jää. Google-haku on jo tunnettu siitä, että se on mennyt dramaattisesti alamäkeen tarjoamiensa tulosten laadun suhteen viimeisen vuosikymmenen aikana. Itse asiassa Googlen laadun heikkeneminen on johtanut tekniikoihin, kuten ”Redditin” lisäämiseen kyselyyn SEO-hakuisten roskapostisivustojen vähentämiseksi, ja se on myös lisännyt AI-chatbottien suosiota, jotka ilmeisesti tarjoavat vastauksia ilman, että hakukoneoptimoija häiritsee (vaikka luottaen niihin vastaukset, kuten olemme nähneet, on kokonaan toinen asia). Ironista kyllä, jotkin tekoälyn tuottamat vastaukset syöttävät takaisin Googlelle, mikä luo epätarkkuuksia, jotka saattavat edelleen heikentää luottamusta Googlen hakutuloksiin.

Onko mitään keinoa astua pois tältä lisääntyvän väärän tiedon juoksumattolta? Google todennäköisesti muuttaa algoritmejaan, mutta ihmiset, jotka tienaavat tekoälyn luomista tietolähteistä, yrittävät jälleen voittaa ne ja parantaa sijoitustaan. Lopputulos on toistaiseksi epävarma, mutta sivuvahinkona on lukemattomien Internetiin luottavien henkilöiden heikentynyt luottamus.

Vastaa