ChatGPT-päivitys mahdollistaa sen tekoälyn ”nähdä, kuulla ja puhua” OpenAI:n mukaan

OpenAI ilmoitti maanantaina merkittävästä ChatGPT:n päivityksestä, jonka avulla sen GPT-3.5- ja GPT-4 AI -mallit voivat analysoida kuvia ja reagoida niihin osana tekstikeskustelua. Lisäksi ChatGPT-mobiilisovellus lisää puhesynteesivaihtoehtoja, jotka yhdistettynä sen olemassa oleviin puheentunnistusominaisuuksiin mahdollistavat täysin verbaaliset keskustelut tekoälyavustajan kanssa, OpenAI sanoo.

OpenAI aikoo ottaa nämä ChatGPT:n ominaisuudet käyttöön Plus- ja Enterprise-tilaajille ”seuraavien kahden viikon aikana”. Se toteaa myös, että puhesynteesi on tulossa vain iOS:lle ja Androidille, ja kuvantunnistus on saatavilla sekä verkkokäyttöliittymässä että mobiilisovellukset.

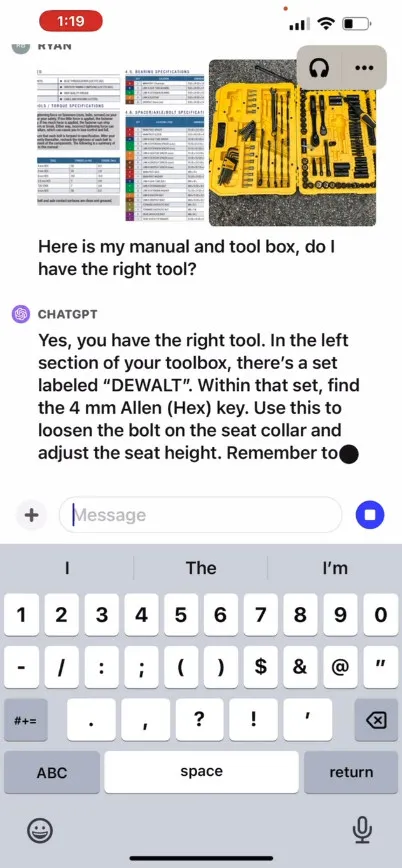

OpenAI sanoo, että ChatGPT:n uuden kuvantunnistusominaisuuden avulla käyttäjät voivat lähettää yhden tai useamman kuvan keskustelua varten joko GPT-3.5- tai GPT-4-malleja käyttäen. Mainosblogiviestissään yritys väittää, että ominaisuutta voidaan käyttää moniin jokapäiväisiin sovelluksiin: illallisen selvittämisestä ottamalla kuvia jääkaapista ja ruokakomerosta vianmääritykseen, miksi grilli ei käynnisty . Siinä sanotaan myös, että käyttäjät voivat käyttää laitteensa kosketusnäyttöä ympyröimään kuvan osia, joihin he haluavat ChatGPT:n keskittyvän.

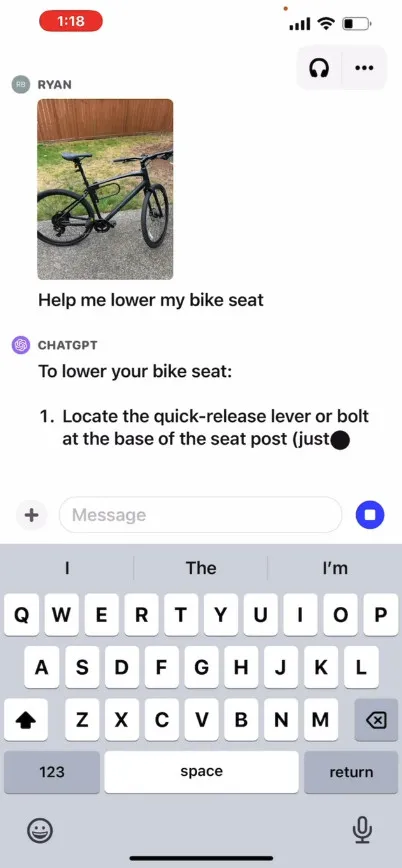

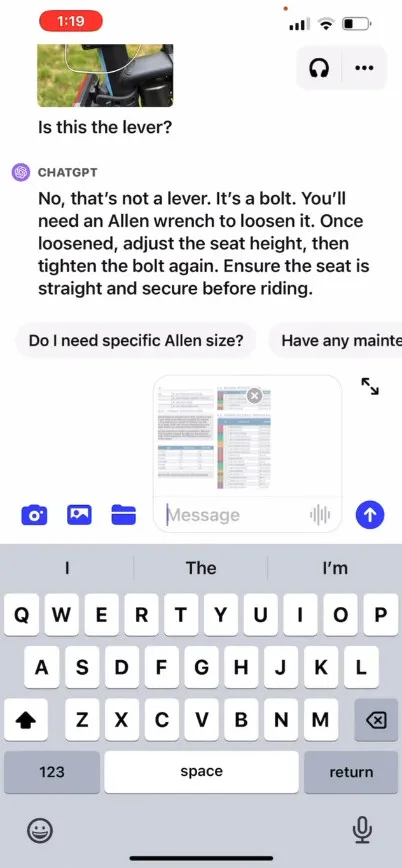

OpenAI tarjoaa sivustollaan mainosvideon , joka havainnollistaa hypoteettista keskustelua ChatGPT:n kanssa, jossa käyttäjä kysyy, kuinka polkupyörän istuin nostetaan, ja tarjoaa valokuvia sekä käyttöohjeen ja kuvan käyttäjän työkalupakkista. ChatGPT reagoi ja neuvoo käyttäjää prosessin suorittamisessa. Emme ole itse testanneet tätä ominaisuutta, joten sen todellista tehokkuutta ei tunneta.

Joten miten se toimii? OpenAI ei ole julkaissut teknisiä yksityiskohtia siitä, kuinka GPT-4 tai sen multimodaalinen versio, GPT-4V , toimivat konepellin alla, mutta muiden (mukaan lukien OpenAI-kumppani Microsoftin ) tunnettujen tekoälytutkimusten perusteella multimodaaliset tekoälymallit muuttavat yleensä tekstiä ja kuvia jaettu koodaustila, jonka avulla he voivat käsitellä erityyppisiä tietoja saman hermoverkon kautta. OpenAI voi käyttää CLIP:iä umpeen visuaalisen ja tekstidatan välisen kuilun tavalla, joka kohdistaa kuvan ja tekstin esitykset samaan piilevään tilaan , eräänlaiseen vektorisoituun tietosuhteiden verkkoon. Tämän tekniikan avulla ChatGPT voi tehdä asiayhteyteen perustuvia päätelmiä tekstistä ja kuvista, vaikka tämä on meidän osaltamme spekulatiivista.

Samaan aikaan äänimaailmassa ChatGPT:n uusi puhesynteesiominaisuus mahdollistaa edestakaisin puhutun keskustelun ChatGPT:n kanssa, jota ohjaa OpenAI:n ”uusi tekstistä puheeksi -malli”, vaikka tekstistä puheeksi -ominaisuus on ratkaistu pitkä aika. Kun ominaisuus otetaan käyttöön, yritys sanoo, että käyttäjät voivat ottaa ominaisuuden käyttöön ottamalla käyttöön äänikeskustelut sovelluksen asetuksista ja valitsemalla sitten viidestä erilaisesta synteettisestä äänestä, joiden nimi on ”Juniper”, ”Sky”, ”Cove”, ”Ember”. ”ja ”Breeze”.OpenAI kertoo, että nämä äänet on luotu yhteistyössä ammattimaisten ääninäyttelijöiden kanssa.

OpenAI:n Whisper, avoimen lähdekoodin puheentunnistusjärjestelmä, jota käsittelimme viime vuoden syyskuussa, jatkaa käyttäjän puhesyötteen transkriptiota. Whisper on integroitu ChatGPT iOS -sovellukseen sen julkaisusta lähtien toukokuussa. OpenAI julkaisi vastaavasti toimivan ChatGPT Android-sovelluksen heinäkuussa.

Vastaa