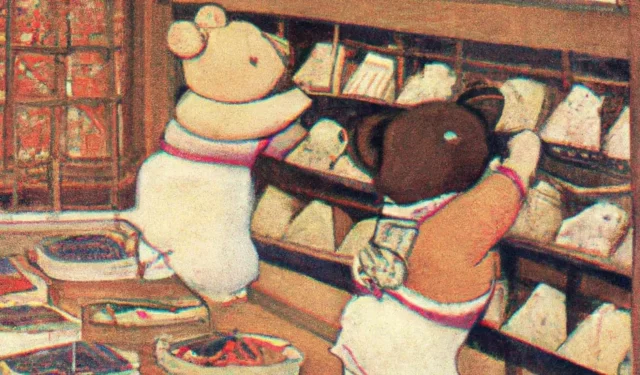

OpenAI DALL-E 2 può eseguire il rendering di immagini di qualsiasi cosa tu possa immaginare

L’intelligenza artificiale OpenAI DALL-E 2 crea immagini di cartoni animati basate su una descrizione testuale della tua immaginazione.

Nel gennaio 2021, il consorzio OpenAI, fondato da Elon Musk e finanziato da Microsoft, ha presentato il suo progetto più ambizioso fino ad oggi, il sistema di apprendimento automatico DALL-E. Questa ingegnosa intelligenza artificiale multimodale è stata in grado di generare immagini in stile cartone animato basate solo su parole chiave specificate dall’utente. Più recentemente, il consorzio ha introdotto una nuova versione di DALL-E con una risoluzione maggiore e una latenza inferiore rispetto alla precedente.

L’intelligenza artificiale OpenAI DALL-E 2 crea immagini di cartoni animati

La prima versione di DALL-E (abbreviazione di Dalie e Wall-E) poteva generare immagini e combinare più immagini in un collage, suggerire diverse angolazioni e persino indovinare una serie di elementi dell’immagine, come effetti di ombra, da una semplice descrizione scritta .

“A differenza di un renderer 3D, il cui input deve essere specificato in modo inequivocabile fin nei minimi dettagli, DALL-E può spesso ‘riempire le lacune’ quando il titolo implica che l’immagine contenga determinati dettagli non esplicitamente dichiarati”, ha spiegato il team. Aprire l’IA nel 2021.

DALL-E non è mai stato pensato per essere un prodotto commerciale, quindi le sue capacità erano limitate poiché il team OpenAI lo considerava solo uno strumento di ricerca. Era anche necessario evitare la situazione che Microsoft aveva con il suo chatbot Tay e che il sistema non potesse generare false informazioni. Per questa seconda versione, gli obiettivi rimangono gli stessi e all’immagine è stata aggiunta una filigrana per indicare chiaramente che è stata creata dall’intelligenza artificiale. Inoltre, il sistema ora vieta agli utenti di creare immagini con nomi propri.

secondo una descrizione testuale presa dalla tua immaginazione

DALL-E 2, che utilizza il sistema di riconoscimento delle immagini OpenAI CLIP, utilizza le sue capacità di generazione delle immagini. Gli utenti possono ora selezionare e modificare aree specifiche di immagini esistenti, aggiungere o rimuovere elementi insieme alle loro ombre, unire due immagini in un collage e creare variazioni di un’immagine esistente. Le immagini generate ora sono quadrati di 1024px, mentre gli avatar originali erano di 256px. CLIP è stato progettato per riassumere il contenuto di un’immagine in modo che possa essere compreso da un essere umano. Il consorzio ha invertito il processo creando un’immagine dalla sua descrizione.

“DALL-E 1 ha preso il nostro approccio GPT-3 al linguaggio e lo ha applicato per creare un’immagine: comprimiamo le immagini in un insieme di parole e abbiamo imparato a prevedere cosa sarebbe successo dopo”, ha spiegato a The Rod il ricercatore Prafulla Dhariwal.

A differenza della prima versione, con cui tutti potevano giocare sul sito OpenAI, questa versione 2 è attualmente disponibile solo per determinati partner e loro stessi sono limitati in ciò che possono fare. Solo pochi fortunati possono usarlo. Inoltre, non possono esportare immagini create su una piattaforma di terze parti, sebbene OpenAI preveda di rendere disponibili le nuove funzionalità di DALL-E 2 tramite un’API in futuro. Se vuoi ancora provare il sistema, puoi unirti alla lista d’attesa .

Lascia un commento