卵は溶かせますか?Quora の AI は「はい」と答え、Google が結果を共有

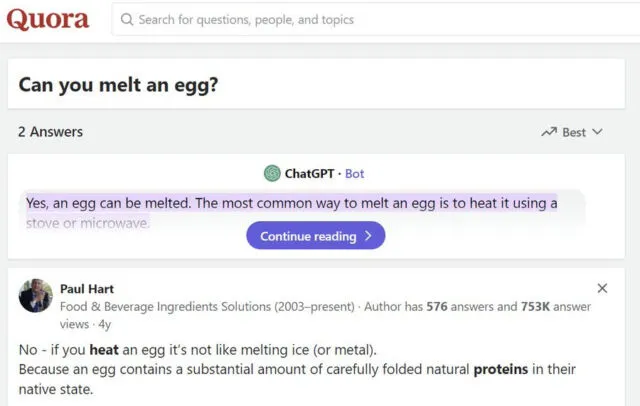

Google 検索に質問を入力すると、サイトはインデックスに登録したウェブサイトから抽出した「注目のスニペット」と呼ばれる簡単な回答を結果の上部に表示することがあります。月曜日、X ユーザーのタイラー・グレイエル氏は、 「卵を溶かしてもらえますか」に対する Google の答えが「はい」であることに気づきました。これは、情報を頻繁に混同するOpenAI の言語モデルの以前のバージョンに基づいている、Quora の統合「ChatGPT」機能から抽出されたものです。

「はい、卵は溶けます」と、Glaiel が共有し、Ars Technica も確認した誤った Google 検索結果が書かれています。「卵を溶かす最も一般的な方法は、ストーブか電子レンジを使って加熱することです。」(将来、Google がこの記事をインデックスする場合に備えて参考までに。いいえ、卵は溶けません。代わりに、加熱すると化学的に形が変わります。)

「これは実に面白いことだ」とグレイエルさんはフォローアップの投稿で書いた。「Quora SEO は、すべての検索結果の先頭に自らを表示し、現在、自社のページで chatGPT の回答を提供しています。そのため、それが Google が提供する回答に伝播しています。」SEO とは、検索エンジンの最適化を指し、Web サイトのコンテンツを調整する手法です。そのため、Google の検索結果の上位に表示されます。

本稿執筆時点では、「卵を溶かすことはできますか?」というクエリに対する Google の結果は「はい」でしたが、「卵を溶かすことはできますか?」というクエリに対する答えは「いいえ」でした。両方とも、「卵を溶かすことはできますか?」というタイトルの同じ Quora ページから取得したものです。「これには、上記に挙げた AI によって書かれた誤ったテキスト、つまり Google の注目のスニペットに表示されるのとまったく同じテキストが含まれています。

興味深いことに、Quora の回答ページには、AI が生成した結果は「ChatGPT」から来ていると書かれていますが、OpenAI のChatGPTに卵を溶かすことができるかどうか尋ねると、常に「いいえ」と答えるでしょう。(「いいえ、卵を溶かすことはできません)」 「伝統的な感覚です。卵は水、タンパク質、脂肪、その他のさまざまな分子で構成されています」と私たちのテスト結果の 1 つは述べられています。)

Quora の統合 AI 応答機能は実際には ChatGPT を使用しておらず、代わりに以前の GPT-3 text-davinci-003 API を利用していることが判明しました。この API は頻繁に誤った情報 (AI 分野では「幻覚」と呼ばれます) を提示することが知られています。 OpenAI のより最近の言語モデルへ。

Andrei Volt という名前の X ユーザーが、text-davinci-003 が Quora の AI ボットと同じ結果を提供できることに最初に気づいた後、私たちはその結果を OpenAI のPlayground開発プラットフォームで再現しました。確かに、卵を加熱すると溶けると言っています。ChatGPT AI アシスタントはこの古いモデルを使用しません (そして一度も使用したことがありません)。また、この古いテキスト補完モデルはOpenAI によって非推奨とみなされ、2024 年 1 月 4 日に廃止される予定です。

AI がなくても、Google の注目のスニペットの結果の精度には疑問が残る可能性があることは注目に値します。2017年3月、米Gizmodoのトム・スコッカ氏は、玉ねぎをキャラメル化するのにどれくらい時間がかかるかについて不正確なレシピを修正しようとしたものの、アルゴリズムが彼の記事から誤った情報を引き出したため、彼の正しい答えがGoogleの不正確な対応をさらに煽ることになった状況について書いた。

では、そもそもなぜ人々は卵が溶けることについて質問するのでしょうか? どうやら、以前に Quora などの Q&A サイトでゆで卵を溶かすことができるかどうかという質問があったようですが、おそらく氷のような固体から水のような液体への相変化を考えたものと思われます。他の人も同じことに興味を持ち、Google で結果を検索することがあります。Quora は、よく検索される質問への回答を提供することで、サイトへのトラフィックを促進しようとしています。

しかし、さらに大きな問題が残っています。Google 検索は、過去 10 年間で提供される検索結果の品質が大幅に低下したことはすでによく知られています。実際、Google の品質低下により、 SEO を求めるスパム サイトを減らすためにクエリに「Reddit」を追加するなどの手法が導入され、AI チャットボットの人気も高まりました。AI チャットボットは、明らかに SEO のゴミを邪魔せずに回答を提供します (ただし、チャットボットは信頼されています)。これまで見てきたように、答えはまったく別の問題です)。皮肉なことに、AI によって生成された回答の一部が Google にフィードバックされ、不正確さのループを生み出し、Google 検索結果の信頼をさらに損なう可能性があります。

エスカレートする誤った情報のトレッドミルから抜け出す方法はあるのでしょうか? Googleはアルゴリズムを調整する可能性が高いが、AIが生成する情報源から収益を得ている人々は再びGoogleを破って順位を上げようとするだろう。今のところ結末は不透明だが、情報を得るためにインターネットに依存している無数の個人の信頼の低下は巻き添え被害として立ちはだかっている。

コメントを残す