계란을 녹일 수 있나요? Quora의 AI는 “예”라고 답하고 Google은 그 결과를 공유합니다.

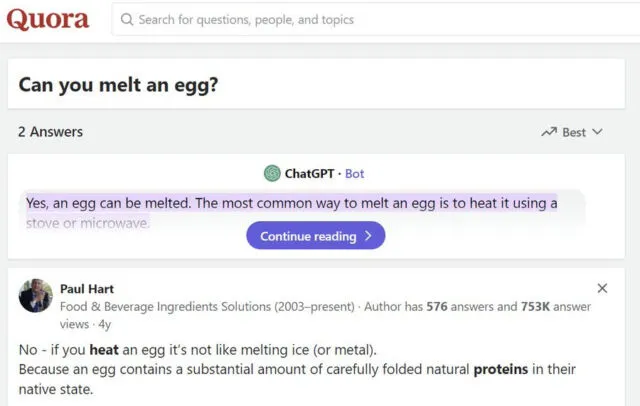

Google 검색에 질문을 입력하면 사이트는 때때로 검색결과 상단에 색인을 생성한 웹사이트에서 가져온 추천 스니펫 이라는 빠른 답변을 제공합니다. 월요일에 X 사용자 Tyler Glaiel은 “계란을 녹일 수 있습니까?”에 대한 Google의 대답이 정보를 자주 구성하는 OpenAI 언어 모델의 이전 버전을 기반으로 하는 Quora의 통합 “ChatGPT” 기능에서 가져온 “예”라는 결과를 가져왔다는 사실을 발견했습니다 .

“예, 계란은 녹을 수 있습니다.” Glaiel이 공유하고 Ars Technica가 확인한 잘못된 Google 검색 결과를 읽습니다. “계란을 녹이는 가장 일반적인 방법은 스토브나 전자레인지를 사용하여 가열하는 것입니다.”(나중에 참고할 수 있도록 Google에서 이 기사를 색인화하는 경우: 아니요, 계란은 녹일 수 없습니다. 대신 가열하면 화학적으로 형태가 변합니다.)

Glaiel은 후속 게시물에서 “이건 정말 재밌습니다.”라고 썼습니다 . “Quora SEO는 모든 검색 결과의 최상위에 올랐으며 이제 페이지에서 chatGPT 답변을 제공하고 있습니다. 따라서 이는 Google이 제공하는 답변으로 전파됩니다.” SEO는 검색 엔진 최적화를 의미하며, 이는 웹 사이트의 콘텐츠를 맞춤화하는 관행 입니다 . 그러면 Google 검색결과에서 더 높은 곳에 표시됩니다.

보도 당시 “계란을 녹일 수 있습니까?”라는 질문에 대한 Google의 결과는 ‘예’였지만 ‘계란을 녹일 수 있습니까’라는 질문에 대한 답변은 ‘아니오’였습니다. 둘 다 ‘계란을 녹일 수 있습니까?’라는 제목의 동일한 Quora 페이지에서 가져온 것입니다 . “여기에는 실제로 위에 나열된 잘못된 AI 작성 텍스트가 포함되어 있습니다. 이는 Google 추천 스니펫에 표시되는 것과 정확히 동일한 텍스트입니다.

흥미롭게도 Quora의 답변 페이지에는 AI 생성 결과가 “ChatGPT”에서 나온다고 나와 있지만 OpenAI의 ChatGPT 에 계란을 녹일 수 있는지 물어보면 변함없이 “아니요”라고 대답합니다. 계란은 물, 단백질, 지방 및 기타 다양한 분자로 구성되어 있습니다.”라고 테스트 결과가 나왔습니다.)

Quora의 통합 AI 답변 기능은 실제로 ChatGPT를 사용하지 않고 대신에 허위 정보(AI 분야에서는 종종 “환각”이라고 함)를 자주 표시하는 것으로 알려진 이전 GPT-3 text-davinci-003 API를 활용하는 것으로 나타났습니다. OpenAI의 최신 언어 모델로.

Andrei Volt라는 X 사용자가 text-davinci-003이 Quora의 AI 봇과 동일한 결과를 제공할 수 있다는 사실 을 처음 알아차린 후, 우리는 OpenAI의 Playground 개발 플랫폼 에 결과를 복제했습니다. 실제로 계란을 가열하여 녹일 수 있다고 말합니다. ChatGPT AI 도우미는 이 이전 모델을 사용하지 않으며(사용한 적도 없음), 이 이전 텍스트 완성 모델은 이제 OpenAI에서 더 이상 사용되지 않는 것으로 간주되어 2024년 1월 4일에 사용 중지됩니다.

AI가 없어도 Google 추천 스니펫 결과의 정확성이 의심스러울 수 있다는 점은 주목할 가치가 있습니다. 2017년 3월 Gizmodo의 Tom Scocca는 양파를 캐러멜화하는 데 걸리는 시간에 대한 부정확한 조리법을 수정하려고 시도했지만 알고리즘이 기사에서 잘못된 정보를 가져왔기 때문에 그의 정답이 Google의 잘못된 응답을 부채질한 상황에 대해 썼습니다 .

그렇다면 왜 사람들은 처음부터 계란을 녹이는 것에 대해 묻는 걸까요? 분명히 사람들은 이전에 Quora와 같은 Q&A 사이트에서 완숙 계란을 녹일 수 있는지 질문한 적이 있는데, 아마도 얼음과 같은 고체가 물과 같은 액체로 변하는 상 변화를 생각하는 것일 것입니다. 다른 사람들도 같은 내용에 대해 호기심을 갖고 가끔 Google에서 결과를 검색 할 수 있습니다 . Quora는 자주 검색되는 질문에 대한 답변을 제공하여 사이트 트래픽을 유도하려고 합니다.

하지만 더 큰 문제가 남아있습니다. Google 검색은 지난 10년 동안 제공하는 결과의 품질 측면에서 급격한 하락세를 보인 것으로 이미 잘 알려져 있습니다. 실제로 Google의 품질 저하로 인해 검색어에 “Reddit”을 추가하여 SEO를 찾는 스팸 사이트를 줄이는 등의 기술 이 등장했으며 AI 챗봇의 인기도 높아졌습니다. 우리가 본 것처럼 답변은 완전히 다른 문제입니다.) 아이러니하게도 AI가 생성한 일부 답변이 Google로 다시 피드백되어 Google 검색 결과에 대한 신뢰를 더욱 약화시킬 수 있는 부정확한 루프가 생성됩니다.

점점 커지는 잘못된 정보의 런닝머신에서 벗어날 수 있는 방법이 있나요? 구글은 알고리즘을 조정할 가능성이 높지만 AI가 생성한 정보 소스로 돈을 버는 사람들은 다시 한번 AI를 물리치고 순위를 높이려고 노력할 것입니다. 현재로서는 최종 게임이 불확실한 상태로 남아 있지만 정보를 얻기 위해 인터넷에 의존하는 수많은 개인의 신뢰가 무너지는 것은 부수적인 피해입니다.

답글 남기기