중국은 AI 모델을 훈련시키기 위해 Hobbled Nvidia 카드를 계속 구매합니다.

미국은 작년에 중국이 군사 목적으로 인공 지능을 개발할 수 있는 능력을 제한하기 위해 공격적으로 행동하여 AI 시스템 훈련에 사용되는 가장 진보된 미국 칩의 판매를 차단했습니다.

생성 AI를 개발하는 데 사용되는 칩의 큰 발전은 중국에서 판매되는 최신 미국 기술이 이전에 사용 가능한 것보다 더 강력하다는 것을 의미했습니다. 그것은 칩이 그들의 능력을 제한하기 위해 중국 시장을 위해 의도적으로 절름발이가 되었다는 사실에도 불구하고, 세계 다른 곳에서 사용할 수 있는 제품보다 덜 효과적입니다.

그 결과 최신 고급 미국 프로세서에 대한 중국 주문이 급증했습니다. 중국의 선도적인 인터넷 회사들은 Nvidia로부터 50억 달러 상당의 칩을 주문했습니다. Nvidia의 그래픽 처리 장치는 대규모 AI 모델을 교육하는 일꾼이 되었습니다.

Nvidia의 제품에 대한 급증하는 글로벌 수요의 영향은 수요일에 발표될 예정인 칩 제조업체의 2분기 재무 결과를 뒷받침할 것으로 보입니다.

인터넷 회사의 최신 대규모 언어 모델을 훈련시키기 위한 개선된 칩에 대한 수요를 반영하는 것 외에도, 미국이 수출 통제를 더욱 강화하여 향후 이러한 제한된 제품도 사용할 수 없게 될 수 있다는 우려로 인해 이러한 러시가 촉발되었습니다.

그러나 Nvidia의 수석 과학자인 Bill Dally는 미국의 수출 통제가 미래에 더 큰 영향을 미칠 것이라고 제안했습니다.

“[가장 진보된 AI 시스템에 대한] 교육 요구 사항이 6개월에서 12개월마다 계속 두 배로 증가함에 따라 중국에서 판매되는 칩과 다른 국가에서 사용 가능한 칩 간의 격차가 “빠르게 커질 것”이라고 그는 말했습니다.

상한 처리 속도

작년 미국의 칩 수출 통제는 중국 고객이 고급 칩을 만드는 데 필요한 장비를 구매하지 못하도록 하는 패키지의 일부였습니다.

워싱턴은 중국에서 판매할 수 있는 칩의 최대 처리 속도와 칩이 데이터를 전송할 수 있는 속도에 대한 상한선을 설정했습니다. 많은 수의 칩을 함께 연결합니다.

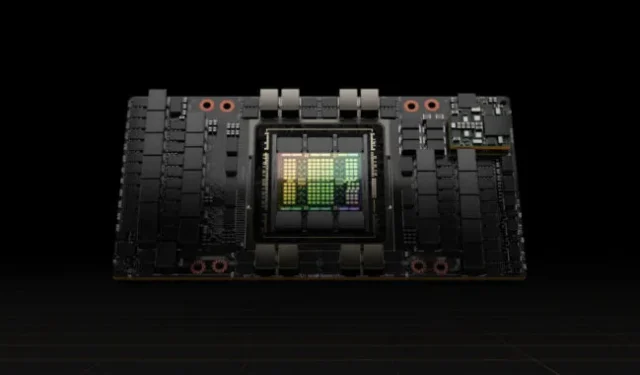

Nvidia는 당시 최고급 GPU였던 A100 프로세서의 데이터 전송 속도를 낮추고 수출 통제를 충족하는 A800이라는 중국용 신제품을 만들어 대응했습니다.

올해는 H100에 대한 데이터 전송 제한을 따랐습니다. H100은 대규모 언어 모델을 훈련하도록 특별히 설계된 새롭고 훨씬 강력한 프로세서로 중국 시장용 H800이라는 버전을 만들었습니다.

이 칩 제조업체는 중국산 프로세서의 기술적 기능을 공개하지 않았지만 컴퓨터 제조업체는 세부 사항에 대해 공개했습니다. 예를 들어 Lenovo는 H800 칩이 포함된 서버가 초당 400GB의 전송 속도를 제외하고는 전 세계에서 판매되는 H100과 모든 면에서 동일하다고 광고합니다.

이는 미국이 중국에 대한 칩 수출에 대해 설정한 600GB/s 한도보다 낮은 것입니다. 이에 비해 Nvidia는 올해 초 고객에게 배송하기 시작한 H100의 전송 속도가 900GB/s라고 밝혔습니다.

중국의 낮은 전송 속도는 중국의 칩 사용자가 전 세계 다른 곳의 Nvidia 고객보다 AI 시스템에 대한 교육 시간이 더 길다는 것을 의미합니다. 이는 모델의 크기가 커짐에 따라 중요한 제한 사항입니다.

훈련 시간이 길어지면 칩이 더 많은 전력을 소비해야 하므로 비용이 증가합니다. 이는 대형 모델에서 가장 큰 비용 중 하나입니다.

그러나 이러한 한계에도 불구하고 중국에서 판매되는 H800 칩은 올해 이전에 출시된 그 어떤 제품보다 강력해 엄청난 수요로 이어지고 있다.

Moor Insights & Strategy의 미국 칩 분석가인 Patrick Moorhead에 따르면 H800 칩은 Nvidia의 가장 강력한 GPU였던 A100 칩보다 5배 더 빠릅니다.

이는 미국의 수출 통제 이전에 구입한 최고급 칩을 사용하여 AI 모델을 훈련시킨 중국 인터넷 회사가 최신 반도체를 구입함으로써 여전히 큰 개선을 기대할 수 있다는 것을 의미한다고 그는 말했습니다.

무어헤드는 “미국 정부는 중국의 AI 노력을 중단하지 않고 더 어렵게 만들고 싶어하는 것 같다”고 말했다.

비용 편익

많은 중국 기술 회사는 여전히 개별 GPU 칩에서 많은 성능을 소모하고 높은 수준의 데이터 전송 기능을 요구하는 대규모 언어 모델을 사전 훈련하는 단계에 있습니다.

Nvidia의 칩만이 사전 훈련에 필요한 효율성을 제공할 수 있다고 중국 AI 엔지니어는 말합니다. 800 시리즈의 개별 칩 성능은 저하된 전송 속도에도 불구하고 여전히 시장의 다른 칩보다 앞서 있습니다.

“Nvidia의 GPU는 비싸 보일 수 있지만 실제로는 가장 비용 효율적인 옵션입니다.”라고 중국 굴지의 인터넷 회사의 한 AI 엔지니어가 말했습니다.

엔지니어는 다른 GPU 벤더들이 더 낮은 가격과 적시 서비스를 제시했지만 회사는 교육 및 개발 비용이 쌓이고 불확실성의 부담이 더 커질 것이라고 판단했다고 말했다.

Nvidia의 제품에는 2006년에 설립되어 AI 인프라의 일부가 된 컴퓨팅 플랫폼 Compute Unified Device Architecture(Cuda)와 함께 소프트웨어 에코시스템이 포함됩니다.

업계 분석가들은 중국 기업들이 800 시리즈 칩 간의 상호 연결 속도에 곧 한계에 직면할 것이라고 믿고 있습니다. 이는 AI 교육에 필요한 데이터의 증가를 처리하는 능력을 방해할 수 있으며 대규모 언어 모델을 연구하고 개발하는 데 더 깊이 파고들 때 방해를 받을 것입니다.

86리서치(86Research)의 상하이 애널리스트 찰리 차이(Charlie Chai)는 이 상황을 고속도로가 혼잡한 많은 공장을 짓는 것과 비교했다. 그는 약화된 칩을 수용할 수 있는 회사라도 향후 2~3년 내에 문제에 직면할 수 있다고 덧붙였다.

© 2023 The Financial Times Ltd. 판권 소유. FT 기사를 복사하여 붙여넣거나 이메일 또는 웹에 게시하여 재배포하지 마십시오.

답글 남기기