Ķīna turpina pirkt slēptās Nvidia kartes, lai apmācītu savus AI modeļus

ASV pagājušajā gadā rīkojās agresīvi, lai ierobežotu Ķīnas spēju attīstīt mākslīgo intelektu militāriem nolūkiem, bloķējot tur pārdot vismodernākās ASV mikroshēmas, ko izmanto AI sistēmu apmācībai.

Lielie sasniegumi ģeneratīvā AI izstrādei izmantoto mikroshēmu jomā ir nozīmējuši, ka jaunākā ASV tehnoloģija, kas tiek pārdota Ķīnā, ir jaudīgāka nekā jebkas cits, kas bija pieejams iepriekš. Tas notiek, neskatoties uz to, ka Ķīnas tirgus ir apzināti sagrozītas mikroshēmas, lai ierobežotu to iespējas, padarot tās mazāk efektīvas nekā citur pasaulē pieejamie produkti.

Rezultāts ir strauji palielinājies Ķīnas pasūtījumu skaits jaunākajiem uzlabotajiem ASV procesoriem. Ķīnas vadošās interneta kompānijas ir pasūtījušas mikroshēmas 5 miljardu dolāru vērtībā no Nvidia, kuras grafiskās apstrādes vienības ir kļuvušas par darba zirgu lielu AI modeļu apmācīšanai.

Augošā globālā pieprasījuma ietekme pēc Nvidia produktiem, visticamāk, būs pamatā mikroshēmu ražotāja otrā ceturkšņa finanšu rezultātiem, kas tiks paziņoti trešdien.

Papildus pieprasījumam pēc uzlabotām mikroshēmām, lai apmācītu interneta uzņēmumu jaunākos lielos valodu modeļus, steigu ir izraisījušas arī bažas, ka ASV varētu vēl vairāk pastiprināt eksporta kontroli, padarot pat šos ierobežotos produktus nepieejamus nākotnē.

Tomēr Nvidia galvenais zinātnieks Bils Dalijs norādīja, ka ASV eksporta kontrolei nākotnē būs lielāka ietekme.

“Tā kā apmācības prasības [vismodernākajām AI sistēmām] turpina dubultoties ik pēc sešiem līdz 12 mēnešiem,” viņš teica, ka atšķirība starp Ķīnā pārdotajām mikroshēmām un pārējā pasaulē pieejamajām mikroshēmām strauji pieaugs.

Apstrādes ātruma ierobežošana

Pagājušajā gadā ASV veiktā čipu eksporta kontrole bija daļa no paketes, kas ietvēra Ķīnas klientu aizliegumu iegādāties modernu mikroshēmu ražošanai nepieciešamo aprīkojumu.

Vašingtona ir noteikusi ierobežojumu maksimālajam mikroshēmu apstrādes ātrumam, ko varētu pārdot Ķīnā, kā arī ātrumu, ar kādu mikroshēmas var pārsūtīt datus — tas ir būtisks faktors, apmācot lielus AI modeļus, kas ir datu ietilpīgs darbs. savienojot kopā lielu skaitu mikroshēmu.

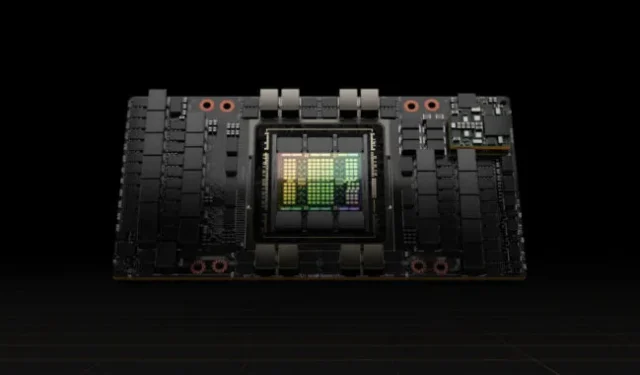

Nvidia atbildēja, samazinot datu pārsūtīšanas ātrumu savos A100 procesoros, kas tajā laikā bija visaugstākie GPU, radot jaunu produktu Ķīnai ar nosaukumu A800, kas atbilst eksporta kontroles prasībām.

Šogad tas sekoja datu pārsūtīšanas ierobežojumiem H100 — jaunam un daudz jaudīgākam procesoram, kas tika īpaši izstrādāts lielu valodu modeļu apmācībai, izveidojot versiju ar nosaukumu H800 Ķīnas tirgum.

Mikroshēmu ražotājs nav atklājis Ķīnai ražoto procesoru tehniskās iespējas, taču datoru ražotāji par detaļām ir bijuši atklāti. Piemēram, Lenovo reklamē serverus, kas satur H800 mikroshēmas, kas, pēc tās teiktā, visos veidos ir identiski citur pasaulē pārdotajiem H100, izņemot to, ka to pārsūtīšanas ātrums ir tikai 400 gigabaiti sekundē.

Tas ir zem 600 GB/s limita, ko ASV noteikusi mikroshēmu eksportam uz Ķīnu. Salīdzinājumam, Nvidia ir teikusi, ka tā H100, kuru tā sāka piegādāt klientiem šā gada sākumā, pārsūtīšanas ātrums ir 900 GB/s.

Zemāks pārsūtīšanas ātrums Ķīnā nozīmē, ka tur esošo mikroshēmu lietotāji saskaras ar ilgāku apmācību laiku savām AI sistēmām nekā Nvidia klienti citur pasaulē — tas ir būtisks ierobežojums, jo modeļi ir palielinājušies.

Ilgāks apmācības laiks palielina izmaksas, jo mikroshēmām būs jāpatērē vairāk enerģijas, kas ir viens no lielākajiem izdevumiem lielu modeļu gadījumā.

Tomēr pat ar šiem ierobežojumiem Ķīnā pārdošanā esošās H800 mikroshēmas ir jaudīgākas nekā jebkur citur līdz šim gadam, kas rada milzīgu pieprasījumu.

Saskaņā ar Patrick Moorhead, ASV mikroshēmu analītiķa Moor Insights & Strategy teikto, H800 mikroshēmas ir piecas reizes ātrākas nekā A100 mikroshēmas, kas bija Nvidia jaudīgākie GPU.

Tas nozīmē, ka Ķīnas interneta uzņēmumi, kas apmācīja savus AI modeļus, izmantojot augstākās klases mikroshēmas, kas iegādātas pirms ASV eksporta kontroles, joprojām var sagaidīt lielus uzlabojumus, pērkot jaunākos pusvadītājus, viņš teica.

“Šķiet, ka ASV valdība vēlas nevis apturēt Ķīnas AI centienus, bet gan padarīt to grūtāku,” sacīja Mūrheds.

Izmaksas-ieguvums

Daudzi Ķīnas tehnoloģiju uzņēmumi joprojām veic lielu valodu modeļu iepriekšēju apmācību, kas nodrošina lielu veiktspēju no atsevišķām GPU mikroshēmām un prasa augstu datu pārsūtīšanas iespēju.

Tikai Nvidia mikroshēmas var nodrošināt iepriekšējai apmācībai nepieciešamo efektivitāti, saka ķīniešu AI inženieri. 800. sērijas individuālā mikroshēmu veiktspēja, neskatoties uz novājinātajiem pārsūtīšanas ātrumiem, joprojām ir priekšā citiem tirgū esošajiem.

“Nvidia GPU var šķist dārgi, bet patiesībā tas ir visrentablākais risinājums,” sacīja viens vadošā Ķīnas interneta uzņēmuma AI inženieris.

Citi GPU pārdevēji piedāvāja zemākas cenas ar savlaicīgāku apkalpošanu, sacīja inženieris, taču uzņēmums uzskatīja, ka apmācības un izstrādes izmaksas palielināsies un ka tam būs papildu nenoteiktības slogs.

Nvidia piedāvājums ietver programmatūras ekosistēmu ar tās skaitļošanas platformu Compute Unified Device Architecture jeb Cuda, ko tā izveidoja 2006. gadā un kas ir kļuvusi par daļu no AI infrastruktūras.

Nozares analītiķi uzskata, ka Ķīnas uzņēmumi drīzumā var saskarties ar ierobežojumiem starpsavienojumu ātrumā starp 800. sērijas mikroshēmām. Tas varētu kavēt viņu spēju tikt galā ar pieaugošo datu apjomu, kas nepieciešams AI apmācībai, un viņi tiks apgrūtināti, jo viņi iedziļināsies lielu valodu modeļu izpētē un izstrādē.

Čārlijs Čai, Šanhajā bāzētais 86Research analītiķis, salīdzināja situāciju ar daudzu rūpnīcu celtniecību ar pārslogotām automaģistrālēm starp tām. Viņš piebilda, ka pat uzņēmumi, kas var pielāgot novājinātās mikroshēmas, var saskarties ar problēmām nākamo divu vai trīs gadu laikā.

© 2023 The Financial Times Ltd. Visas tiesības paturētas. Lūdzu, nekopējiet un neielīmējiet FT rakstus un neizplatiet tos pa e-pastu vai nepublicējiet tīmeklī.

Atbildēt