Alexa zal de stemmen van de levenden en de doden deepfaken bij de ontwikkeling van functies

Amazon is aan het uitzoeken hoe Alexa’s stemassistent de stem van iedereen, dood of levend, diep kan vervalsen met slechts een korte opname. Het bedrijf presenteerde de functie woensdag op zijn re: Mars- conferentie in Las Vegas, waarbij het emotionele trauma van de aanhoudende pandemie en het verdriet werd gebruikt om interesse te wekken.

Amazon’s Re:Mars richt zich op kunstmatige intelligentie, machine learning, robotica en andere opkomende technologieën, met technische experts en marktleiders op het podium. Tijdens de keynote van de tweede dag liet Rohit Prasad, Senior Vice President en Chief Scientist van Alexa AI bij Amazon, een functie zien die momenteel wordt ontwikkeld voor Alexa.

In de demonstratie vraagt een kind aan Alexa: “Kan oma de tovenaar van Oz voor mij uitlezen?” Alexa antwoordt: “Oké”, met haar typische verwijfde robotstem. Maar dan klinkt de stem van de grootmoeder van het kind uit de spreker, die een sprookje voorleest van L. Frank Baum.

Hieronder kun je een demo bekijken:

Prasad zei alleen dat Amazon “werkt” aan de Alexa-mogelijkheid, en ging niet in op wat er nog over is en wanneer en of het beschikbaar zal zijn.

Hij verstrekte echter de kleinste technische details.

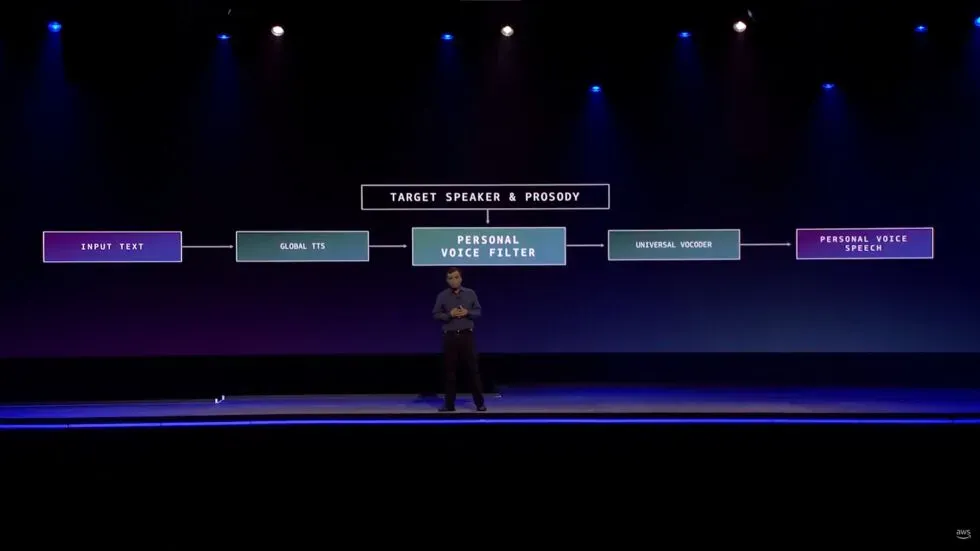

“Het vergde een vindingrijkheid toen we moesten leren hoe we stemmen van hoge kwaliteit konden reproduceren in minder dan een minuut opname vergeleken met uren opname in de studio,” zei hij. “We hebben dit mogelijk gemaakt door het probleem te kaderen als een probleem met stemconversie in plaats van een probleem met het genereren van spraak.”

Natuurlijk hebben alle soorten deepfakes over het algemeen een gemengde reputatie. Er zijn echter enkele pogingen gedaan om de technologie te gebruiken als een hulpmiddel in plaats van een voertuig voor griezeligheid.

Met name audio-deepfakes, zoals The Verge opmerkt, zijn in de media gebruikt om goed te maken wanneer bijvoorbeeld een podcaster een regel verprutste of wanneer de ster van een project plotseling stierf, zoals gebeurde met de Roadrunner-documentaire van Anthony Bourdain .

De publicatie merkt op dat er zelfs gevallen zijn van mensen die AI gebruiken om chatbots te maken die communiceren alsof ze verloren dierbaren zijn.

Alexa zal niet eens het eerste consumentenproduct zijn dat deepfake audio gebruikt om een familielid te vervangen dat niet persoonlijk aanwezig kan zijn. Slimme spreker Takara Tomy , zoals Giz modo opmerkt, gebruikt kunstmatige intelligentie om verhaaltjes voor het slapengaan aan kinderen voor te lezen in de stem van een ouder. Er wordt gemeld dat ouders hun stem uploaden door het script ongeveer 15 minuten te lezen, om zo te zeggen. Hoewel dit aanzienlijk verschilt van de demo van Amazon doordat de producteigenaar ervoor kiest om zijn eigen zang te geven in plaats van het product met de stem van iemand die waarschijnlijk geen toestemming kan geven.

Afgezien van zorgen over deepfakes die worden gebruikt voor oplichting, overvallen en andere snode activiteiten, zijn er al enkele verontrustende dingen over hoe Amazon deze functie bouwt, die nog niet eens een releasedatum heeft.

Voordat hij de demo liet zien, vertelde Prasad hoe Alexa gebruikers een “kameraadschapsrelatie” geeft.

“In deze kameraadschapsrol zijn de menselijke eigenschappen van empathie en affectie de sleutel tot het opbouwen van vertrouwen”, aldus de CEO. “Deze eigenschappen zijn nog belangrijker geworden tijdens de aanhoudende pandemie, wanneer velen van ons iemand hebben verloren van wie we houden. Hoewel de AI deze pijn van verlies niet kan wegnemen, kan het zeker hun geheugen uitbreiden.”

Prasad voegde eraan toe dat de functie “een duurzame persoonlijke relatie biedt”.

Het is waar dat talloze mensen serieus op zoek zijn naar menselijke “empathie en affectie” als reactie op de emotionele stress veroorzaakt door de COVID-19-pandemie. De kunstmatige intelligentie-stemassistent van Amazon is echter niet in staat om aan deze menselijke behoeften te voldoen. Alexa kan ook geen “langdurige persoonlijke relaties” bieden met mensen die niet meer bij ons zijn.

Het is niet moeilijk te geloven dat er goede bedoelingen achter deze evoluerende functie zitten en dat het horen van de stem van de persoon die je mist een grote troost kan zijn. Theoretisch zouden we zelfs plezier kunnen hebben met zo’n functie. Alexa een vriend laten klinken alsof ze zeiden dat iets stoms onschadelijk is. En, zoals we hierboven al zeiden, er zijn andere bedrijven die deepfake-technologie gebruiken op een manier die vergelijkbaar is met wat Amazon heeft gedemonstreerd.

Maar het evoluerende vermogen van Alexa presenteren als een manier om opnieuw contact te maken met overleden familieleden, is een gigantische, onrealistische en problematische sprong. Ondertussen lijkt het nutteloos om de snaren van het hart aan te raken, waardoor verdriet en eenzaamheid worden veroorzaakt die verband houden met de pandemie. Er zijn plaatsen waar Amazon niet thuishoort, en rouwbegeleiding is daar een van.

Geef een reactie