OpenAI’s nieuwe AI-beeldgenerator verlegt de grenzen in detail en zorgt voor natuurgetrouwheid

Woensdag kondigde OpenAI DALL-E 3 aan, de nieuwste versie van zijn AI-beeldsynthesemodel dat volledige integratie met ChatGPT biedt . DALL-E 3 geeft afbeeldingen weer door complexe beschrijvingen nauwkeurig te volgen en tekstgeneratie in de afbeelding (zoals labels en tekens) te verwerken, wat eerdere modellen uitdaagde. Momenteel bevindt het zich in een onderzoekspreview en zal begin oktober beschikbaar zijn voor ChatGPT Plus- en Enterprise-klanten.

Net als zijn voorganger is DALLE-3 een tekst-naar-afbeelding-generator die nieuwe afbeeldingen creëert op basis van geschreven beschrijvingen die prompts worden genoemd. Hoewel OpenAI geen technische details over DALL-E 3 heeft vrijgegeven, is het AI-model dat de kern vormt van eerdere versies van DALL-E getraind op miljoenen afbeeldingen die zijn gemaakt door menselijke kunstenaars en fotografen, waarvan sommige zijn gelicentieerd via aandelenwebsites zoals Shutterstock . Het is waarschijnlijk dat DALL-E 3 dezelfde formule volgt, maar met nieuwe trainingstechnieken en meer computationele trainingstijd.

Afgaande op de voorbeelden die OpenAI op zijn promotieblog heeft gegeven, lijkt DALL-E 3 een radicaal capabeler model voor beeldsynthese dan al het andere dat beschikbaar is in termen van het volgen van aanwijzingen. Hoewel de voorbeelden van OpenAI zijn uitgekozen vanwege hun effectiviteit, lijken ze de promptinstructies getrouw en overtuigend te volgen en objecten met minimale vervormingen weer te geven. Vergeleken met DALL-E 2 zegt OpenAI dat DALL-E 3 kleine details, zoals handen, effectiever verfijnt, waardoor standaard boeiende afbeeldingen worden gemaakt zonder “hacks of snelle engineering vereist.”

Ter vergelijking: Midjourney , een concurrerend AI-beeldsynthesemodel van een andere leverancier, geeft fotorealistische details goed weer, maar het vereist nog steeds veel contra-intuïtief sleutelen aan aanwijzingen om enige controle over de beelduitvoer te krijgen.

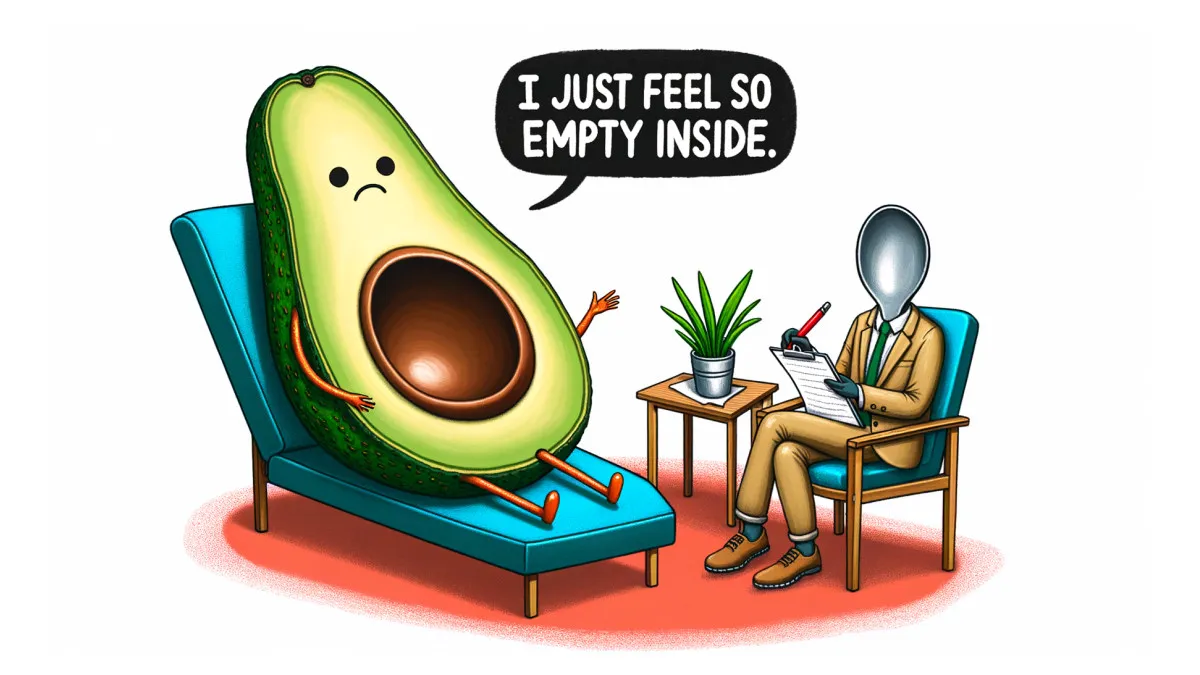

DALL-E 3 lijkt ook met tekst in afbeeldingen om te gaan op een manier die zijn voorganger niet kon (sommige concurrerende modellen zoals Stable Diffusion XL en DeepFloyd worden er steeds beter in). Een prompt met de woorden: ‘Een illustratie van een avocado die in de stoel van een therapeut zit en zegt: ‘Ik voel me zo leeg van binnen’ met een gat ter grootte van een put in het midden, creëerde bijvoorbeeld een cartoon-avocado met de karaktercitaat perfect. ingekapseld in een tekstballon.

OpenAI zegt met name dat DALL-E 3 “native” is gebouwd op ChatGPT en zal verschijnen als een geïntegreerde functie van ChatGPT Plus, waardoor conversatieverfijningen aan afbeeldingen mogelijk worden op een manier die de AI-assistent als brainstormpartner zal gebruiken. Het betekent ook dat ChatGPT afbeeldingen kan genereren op basis van de context van het huidige gesprek, wat kan leiden tot nieuwe nieuwe mogelijkheden. De Bing Chat AI-assistent van Microsoft, eveneens gebouwd op technologie van OpenAI, kan sinds maart afbeeldingen genereren in gesprekken .

Geef een reactie