Wojny z asystentami AI zaostrzają się wraz z pojawieniem się Claude’a Pro, nowego rywala ChatGPT Plus

W czwartek twórca sztucznej inteligencji i konkurent OpenAI, firma Anthropic, uruchomiła Claude Pro , opartą na subskrypcji wersję swojego internetowego asystenta AI Claude.ai , który działa podobnie do ChatGPT. Jest dostępny za 20 dolarów miesięcznie w USA lub 18 funtów miesięcznie w Wielkiej Brytanii i zapewnia pięciokrotnie wyższe limity użytkowania, priorytetowy dostęp do Claude w okresach największego ruchu oraz wcześniejszy dostęp do nowych funkcji, gdy tylko się pojawią.

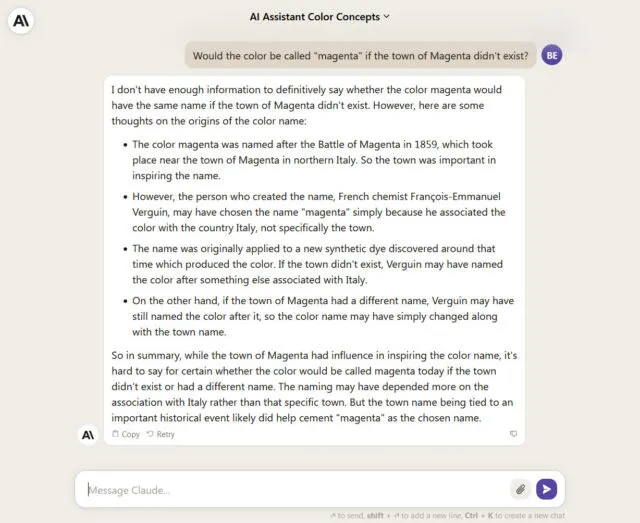

Podobnie jak ChatGPT, Claude Pro może tworzyć tekst, podsumowywać, przeprowadzać analizy, rozwiązywać zagadki logiczne i nie tylko.

Claude.ai jest tym, co Anthropic oferuje jako interfejs konwersacyjny dla swojego modelu języka AI Claude 2, podobnie jak ChatGPT zapewnia opakowanie aplikacji dla podstawowych modeli GPT-3.5 i GPT-4. W lutym OpenAI wybrało opcję subskrypcji ChatGPT Plus , która za 20 dolarów miesięcznie zapewnia także wcześniejszy dostęp do nowych funkcji, ale odblokowuje także dostęp do GPT-4, czyli najpotężniejszego modelu językowego OpenAI.

Co ma Claude, czego nie ma ChatGPT? Dużą różnicą jest okno kontekstowe zawierające 100 000 tokenów , co oznacza, że może przetworzyć około 75 000 słów jednocześnie. Tokeny to fragmenty słów używane podczas przetwarzania tekstu. Oznacza to, że Claude może analizować dłuższe dokumenty lub prowadzić dłuższe rozmowy, nie tracąc pamięci na dany temat. ChatGPT może przetworzyć tylko około 8000 tokenów w trybie GPT-4.

„Dla mnie najważniejszą rzeczą jest limit 100 000 tokenów” – powiedział Ars Technica badacz sztucznej inteligencji Simon Willison. „To ogromne! Otwiera zupełnie nowe możliwości i używam go kilka razy w tygodniu właśnie dla tej funkcji”. Willison regularnie pisze o korzystaniu z Claude na swoim blogu i często używa go do porządkowania transkrypcji swoich rozmów osobistych. Chociaż ostrzega również przed „halucynacjami”, podczas których Claude czasami zmyśla.

„Zdecydowanie widziałem też więcej halucynacji u Claude’a” w porównaniu z GPT-4, mówi Willison, „co denerwuje mnie, gdy używam go do dłuższych zadań, ponieważ istnieje o wiele więcej możliwości wślizgnięcia się w coś halucynacyjnego bez mojej wiedzy. ”

Willison napotkał także problemy z filtrem moralności Claude’a, co przysporzyło mu kłopotów przez przypadek: „Próbowałem użyć go w przypadku transkrypcji odcinka podcastu i przetworzył większość tekstu, zanim – tuż przed moimi oczami – usunął wszystko, co zrobił! W końcu zorientowałem się, że zaczęliśmy rozmawiać o groźbach bombowych przeciwko centrom danych pod koniec odcinka, co Claude’a skutecznie to poruszyło i usunął cały zapis.

Co oznacza „5 razy większe wykorzystanie”?

Głównym argumentem Anthropic dotyczącym subskrypcji Claude Pro jest „ 5 razy większe wykorzystanie ”, ale firma nie informuje jasno, jakie są faktycznie limity wykorzystania Claude w przypadku bezpłatnego poziomu subskrypcji. Upuszczając wskazówki, takie jak tajemnicze bułki tarte, firma napisała dokument wsparcia na ten temat, który brzmi: „Jeśli Twoje rozmowy są stosunkowo krótkie (około 200 zdań po angielsku, zakładając, że Twoje zdania składają się z około 15–20 słów), możesz spodziewać się wysłania co najmniej 100 wiadomości co 8 godzin, często więcej w zależności od aktualnych możliwości Claude’a. Ponad dwie trzecie wszystkich rozmów na claude.ai (stan na wrzesień 2023 r.) dotyczyło tej długości”.

W innym nieco tajemniczym oświadczeniu firma Anthropic pisze: „Jeśli prześlesz kopię Wielkiego Gatsby’ego , w ciągu 8 godzin w tej rozmowie być może uda się wysłać tylko 20 wiadomości”. Nie próbujemy liczyć, ale jeśli znasz dokładnej liczby słów w klasyku F. Scotta Fitzgeralda, być może uda się ustalić rzeczywiste ograniczenia Claude’a. Wczoraj skontaktowaliśmy się z firmą Anthropic w celu uzyskania wyjaśnień i do czasu wydania prasy nie otrzymaliśmy odpowiedzi.

Tak czy inaczej, Anthropic wyjaśnia, że w przypadku modelu sztucznej inteligencji z limitem kontekstu wynoszącym 100 000 tokenów limity użycia są konieczne, ponieważ związane z tym obliczenia są kosztowne. „Model tak wydajny jak Claude 2 wymaga do działania wielu wydajnych komputerów, zwłaszcza podczas odpowiadania na duże załączniki i długie rozmowy” – pisze Anthropic w dokumencie wsparcia. „Ustalaliśmy te limity, aby zapewnić możliwość bezpłatnego wypróbowania Claude wielu osobom, a jednocześnie umożliwić zaawansowanym użytkownikom integrację Claude z codziennymi przepływami pracy”.

Ponadto w piątek firma Anthropic uruchomiła Claude Instant 1.2 , która jest tańszą i szybszą wersją Claude dostępną za pośrednictwem interfejsu API. Jednak w zadaniach logicznych jest mniej wydajny niż Claude 2.

Choć jasne jest, że duże modele językowe, takie jak Claude, mogą robić ciekawe rzeczy, wydaje się, że ich wady i tendencja do konfabulacji mogą powstrzymywać je od szerszego zastosowania ze względu na obawy dotyczące niezawodności. Mimo to Willison jest fanem Claude 2 w wersji internetowej: „Jestem podekscytowany możliwością ciągłego doskonalenia gry. 100 000 tokenów to ogromna wygrana, a fakt, że można do niego przesyłać pliki PDF, jest naprawdę wygodny”.

Dodaj komentarz