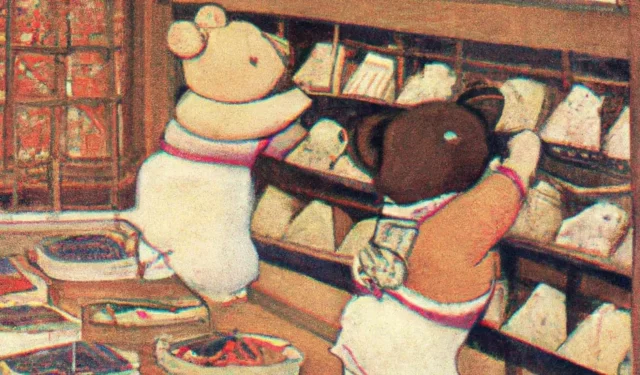

OpenAI DALL-E 2 może renderować obrazy wszystkiego, co możesz sobie wyobrazić

Sztuczna inteligencja OpenAI DALL-E 2 tworzy obrazy z kreskówek na podstawie opisu tekstowego z Twojej wyobraźni.

W styczniu 2021 roku konsorcjum OpenAI, założone przez Elona Muska i finansowane przez Microsoft, zaprezentowało swój najambitniejszy dotychczas projekt, system uczenia maszynowego DALL-E. Ta genialna, multimodalna sztuczna inteligencja była w stanie generować obrazy w stylu kreskówek na podstawie słów kluczowych określonych przez użytkownika. Niedawno konsorcjum wprowadziło nową wersję DALL-E o wyższej rozdzielczości i mniejszych opóźnieniach niż poprzednia.

Sztuczna inteligencja OpenAI DALL-E 2 tworzy obrazki z kreskówek

Pierwsza wersja DALL-E (skrót od Dalie i Wall-E) mogła generować obrazy i łączyć wiele obrazów w kolaż, sugerować różne kąty, a nawet odgadywać liczbę elementów obrazu – takich jak efekty cieni – na podstawie prostego pisemnego opisu .

„W przeciwieństwie do renderera 3D, którego dane wejściowe muszą być określone w sposób jednoznaczny co do najmniejszego szczegółu, DALL-E często może„ wypełnić luki ”, gdy tytuł sugeruje, że obraz zawiera pewne szczegóły, które nie zostały wyraźnie określone” — wyjaśnił zespół. Otwarta sztuczna inteligencja w 2021 roku.

DALL-E nigdy nie miał być produktem komercyjnym, więc jego możliwości były ograniczone, ponieważ zespół OpenAI uważał go jedynie za narzędzie badawcze. Konieczne było również uniknięcie sytuacji, w której Microsoft miał ze swoim chatbotem Tay i że system nie mógł generować fałszywych informacji. W przypadku tej drugiej wersji cele pozostają takie same, a do obrazu dodano znak wodny, aby wyraźnie wskazać, że został on stworzony przez sztuczną inteligencję. Ponadto system zabrania teraz użytkownikom tworzenia obrazów z nazwami własnymi.

zgodnie z tekstowym opisem zaczerpniętym z twojej wyobraźni

DALL-E 2, który wykorzystuje system rozpoznawania obrazu OpenAI CLIP, wykorzystuje jego możliwości generowania obrazu. Użytkownicy mogą teraz wybierać i edytować określone obszary istniejących obrazów, dodawać lub usuwać elementy wraz z ich cieniami, łączyć dwa obrazy w jeden kolaż i tworzyć odmiany istniejącego obrazu. Wygenerowane obrazy mają teraz kwadraty o wielkości 1024 pikseli, podczas gdy oryginalne awatary miały rozmiar 256 pikseli. CLIP został zaprojektowany w celu podsumowania treści obrazu w sposób zrozumiały dla człowieka. Konsorcjum odwróciło ten proces, tworząc obraz z jego opisu.

„DALL-E 1 wykorzystał nasze podejście GPT-3 do języka i zastosował je do stworzenia obrazu: kompresujemy obrazy do zestawu słów i nauczyliśmy się przewidywać, co będzie dalej” – wyjaśnił badacz Prafulla Dhariwal w rozmowie z The Rod.

W przeciwieństwie do pierwszej wersji, w którą każdy mógł grać na stronie OpenAI, ta wersja 2 jest obecnie dostępna tylko dla niektórych partnerów, a oni sami mają ograniczone możliwości. Tylko nieliczni szczęśliwcy mogą z niego korzystać. Nie mogą również eksportować obrazów utworzonych na platformie innej firmy, chociaż OpenAI planuje w przyszłości udostępnić nowe funkcje DALL-E 2 za pośrednictwem interfejsu API. Jeśli nadal chcesz wypróbować system, możesz zapisać się na listę oczekujących .

Dodaj komentarz