Alexa fará deepfake das vozes dos vivos e dos mortos no desenvolvimento do recurso

A Amazon está descobrindo como fazer o assistente de voz de Alexa falsificar profundamente a voz de qualquer pessoa, viva ou morta, com apenas uma pequena gravação. A empresa apresentou o recurso em sua conferência re:Mars em Las Vegas na quarta-feira, usando o trauma emocional da pandemia em andamento e o luto para gerar interesse.

O Re:Mars da Amazon se concentra em inteligência artificial, aprendizado de máquina, robótica e outras tecnologias emergentes, com especialistas em tecnologia e líderes do setor no palco. Durante a palestra do segundo dia, Rohit Prasad, vice-presidente sênior e cientista-chefe da Alexa AI na Amazon, exibiu um recurso que está sendo desenvolvido para a Alexa.

Na demonstração, uma criança pergunta a Alexa: “A vovó pode terminar de ler O Mágico de Oz para mim?” Alexa responde: “Tudo bem”, em sua típica voz robótica efeminada. Mas então a voz da avó da criança é ouvida do alto-falante, que está lendo um conto de fadas de L. Frank Baum.

Você pode assistir a uma demonstração abaixo:

Prasad disse apenas que a Amazon está “trabalhando” no recurso Alexa e não detalhou qual trabalho resta e quando ou se estará disponível.

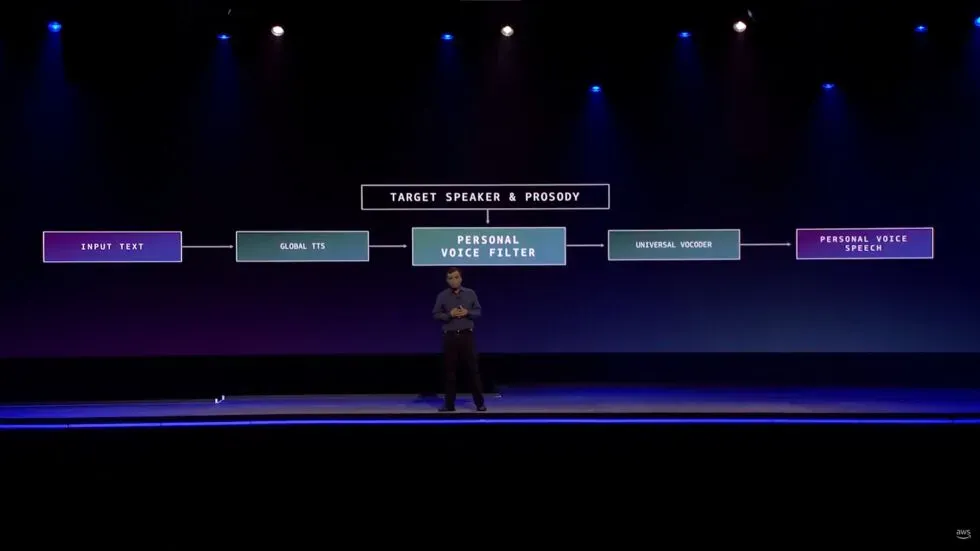

No entanto, ele forneceu os menores detalhes técnicos.

“Foi necessário invenção quando tivemos que aprender a reproduzir voz de alta qualidade em menos de um minuto de gravação em comparação com horas de gravação no estúdio”, disse ele. “Tornamos isso possível enquadrando o problema como um problema de conversão de voz, em vez de um problema de geração de fala.”

Claro, deepfakes de todos os tipos geralmente têm uma reputação mista. No entanto, algumas tentativas foram feitas para usar a tecnologia como uma ferramenta, em vez de um veículo para a bizarrice.

Os deepfakes de áudio, em particular, como observa o The Verge, foram usados na mídia para compensar quando, digamos, um podcaster estragou uma linha ou quando a estrela de um projeto morreu repentinamente, como aconteceu com o documentário Roadrunner de Anthony Bourdain .

A publicação observa que há até casos de pessoas usando IA para criar chatbots que se comunicam como se fossem entes queridos perdidos.

Alexa nem será o primeiro produto de consumo a usar áudio deepfake para substituir um membro da família que não pode estar presente pessoalmente. O alto-falante inteligente Takara Tomy , como Gi z modo aponta, usa inteligência artificial para ler histórias de ninar para crianças na voz de um pai. Os pais são relatados para enviar suas vozes lendo o roteiro por cerca de 15 minutos, por assim dizer. Embora isso seja muito diferente da demonstração da Amazon, pois o proprietário do produto escolhe fornecer seus próprios vocais em vez do produto usando a voz de alguém que provavelmente não pode dar sua permissão.

Além das preocupações com o uso de deepfakes para golpes, roubos e outras atividades nefastas, já existem algumas coisas perturbadoras sobre como a Amazon está construindo esse recurso, que ainda nem tem data de lançamento.

Antes de mostrar a demonstração, Prasad falou sobre como o Alexa oferece aos usuários um “relacionamento de camaradagem”.

“Nesse papel de camaradagem, as qualidades humanas de empatia e afeto são fundamentais para construir confiança”, disse o CEO. “Esses atributos se tornaram ainda mais importantes durante a pandemia em curso, quando muitos de nós perdemos alguém que amamos. Embora a IA não possa eliminar essa dor da perda, ela pode definitivamente estender sua memória.”

Prasad acrescentou que o recurso “fornece um relacionamento pessoal duradouro”.

É verdade que inúmeras pessoas estão buscando seriamente “empatia e afeto” humanos em resposta ao estresse emocional causado pela pandemia do COVID-19. No entanto, o assistente de voz de inteligência artificial da Amazon não está à altura da tarefa de atender a essas necessidades humanas. A Alexa também não pode fornecer “relacionamentos pessoais de longo prazo” com pessoas que não estão mais conosco.

Não é difícil acreditar que existam boas intenções por trás dessa característica evolutiva e que ouvir a voz da pessoa que você sente falta pode ser um grande conforto. Teoricamente, poderíamos até nos divertir com esse recurso. Fazendo Alexa fazer um amigo parecer que disse algo estúpido é inofensivo. E, como dissemos acima, existem outras empresas que usam a tecnologia deepfake de maneira semelhante à que a Amazon demonstrou.

Mas apresentar a capacidade evolutiva do Alexa como uma forma de se reconectar com familiares falecidos é um salto gigantesco, irreal e problemático. Enquanto isso, tocar nas cordas do coração, causando tristeza e solidão associadas à pandemia, parece ser fútil. Há lugares aos quais a Amazon não pertence, e o aconselhamento de luto é um deles.

Deixe um comentário