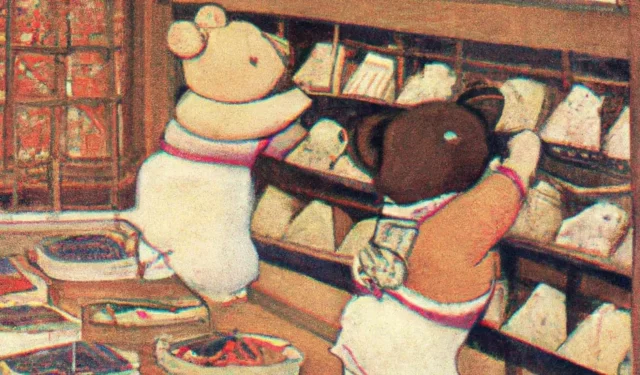

OpenAI DALL-E 2 kan återge bilder av allt du kan föreställa dig

OpenAI DALL-E 2 artificiell intelligens skapar tecknade bilder baserat på en textbeskrivning från din fantasi.

I januari 2021 presenterade OpenAI-konsortiet, grundat av Elon Musk och finansierat av Microsoft, sitt mest ambitiösa projekt hittills, maskininlärningssystemet DALL-E. Denna geniala multimodala artificiella intelligens kunde generera bilder i tecknad stil baserade endast på användarspecificerade nyckelord. På senare tid introducerade konsortiet en ny version av DALL-E med högre upplösning och lägre latens än den tidigare.

Artificiell intelligens OpenAI DALL-E 2 skapar tecknade bilder

Den första versionen av DALL-E (förkortning för Dalie och Wall-E) kunde generera bilder och kombinera flera bilder till ett collage, föreslå olika vinklar och till och med gissa ett antal bildelement – som skuggeffekter – utifrån en enkel skriftlig beskrivning .

”Till skillnad från en 3D-renderare, vars input måste specificeras entydigt in i minsta detalj, kan DALL-E ofta ”fylla i luckorna” när titeln antyder att bilden innehåller vissa detaljer som inte uttryckligen anges,” förklarade teamet. Öppna AI 2021.

DALL-E var aldrig tänkt att vara en kommersiell produkt, så dess möjligheter var begränsade eftersom OpenAI-teamet bara ansåg det som ett forskningsverktyg. Det var också nödvändigt att undvika den situation som Microsoft hade med sin Tay chatbot och att systemet inte kunde generera falsk information. För den här andra versionen förblir målen desamma, och en vattenstämpel har lagts till bilden för att tydligt indikera att den skapades av artificiell intelligens. Dessutom förbjuder systemet nu användare att skapa bilder med egennamn.

enligt en textbeskrivning hämtad från din fantasi

DALL-E 2, som använder OpenAI CLIP bildigenkänningssystem, använder sina bildgenereringsmöjligheter. Användare kan nu välja och redigera specifika områden av befintliga bilder, lägga till eller ta bort element tillsammans med deras skuggor, slå samman två bilder till ett kollage och skapa varianter av en befintlig bild. De genererade bilderna är nu 1024px kvadrater, medan de ursprungliga avatarerna var 256px. CLIP utformades för att sammanfatta innehållet i en bild på ett sätt som kan förstås av en människa. Konsortiet vände processen genom att skapa en bild från hans beskrivning.

”DALL-E 1 tog vår GPT-3-inställning till språk och använde den för att skapa en bild: vi komprimerar bilder till en uppsättning ord och lärde oss att förutsäga vad som skulle hända härnäst”, förklarade forskaren Prafulla Dhariwal till The Rod.

Till skillnad från den första versionen, som alla kunde spela med på OpenAI-sajten, är denna version 2 för närvarande endast tillgänglig för vissa partners, och de själva är begränsade i vad de kan göra. Endast ett fåtal lyckliga får använda den. De kan inte heller exportera bilder skapade på en tredjepartsplattform, även om OpenAI planerar att göra DALL-E 2:s nya funktioner tillgängliga via ett API i framtiden. Om du ändå vill prova systemet kan du gå med på väntelistan .

Lämna ett svar