Alexa將在功能開發中深度偽造生者和死者的聲音

亞馬遜正在研究如何讓 Alexa 的語音助手通過一段簡短的錄音,深度模仿任何人的聲音,無論是死的還是活著的。該公司週三在拉斯維加斯舉行的re:Mars 會議上展示了這一功能,利用持續流行病和悲傷造成的情感創傷來引起人們的興趣。

亞馬遜的 Re:Mars 專注於人工智能、機器學習、機器人技術和其他新興技術,技術專家和行業領導者登台亮相。在第二天的主題演講中,亞馬遜 Alexa AI 高級副總裁兼首席科學家 Rohit Prasad 展示了目前正在為 Alexa 開發的一項功能。

在演示中,一個孩子問 Alexa,“奶奶可以幫我讀完《綠野仙踪》嗎?”Alexa 用她典型的女性化機器人聲音回答:“好的。” 但隨後,揚聲器里傳來了孩子祖母的聲音,她正在朗讀 L. Frank Baum 的童話故事。

您可以觀看下面的演示:

普拉薩德只表示亞馬遜正在“研究”Alexa 功能,但沒有詳細說明還剩下哪些工作以及何時或是否可用。

然而,他提供了最小的技術細節。

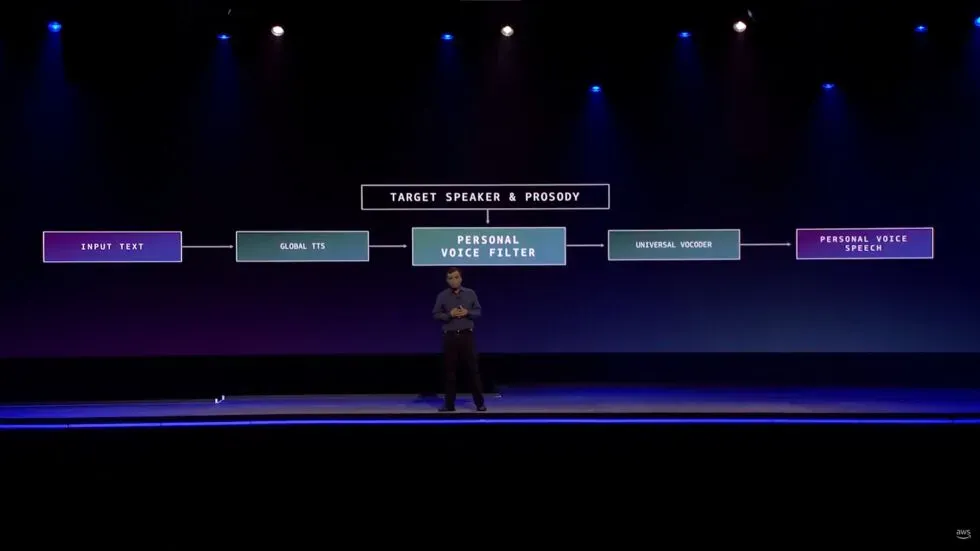

“當我們必須學習如何在不到一分鐘的錄音中再現高質量的聲音(與在錄音室中錄音數小時相比)時,這就需要發明,”他說。“我們通過將問題視為語音轉換問題而不是語音生成問題,使這成為可能。”

當然,各種類型的深度贗品通常都有不同的聲譽。然而,已經有人嘗試將該技術用作一種工具,而不是一種令人毛骨悚然的工具。

正如The Verge 指出的那樣,音頻深度偽造尤其被媒體用來彌補播客搞砸台詞或項目明星突然去世的情況,就像安東尼·波登 (Anthony Bourdain) 的走鵑紀錄片 (Roadrunner) 所發生的那樣。

該出版物指出,甚至有人使用人工智能創建聊天機器人,就像失去親人一樣進行交流。

Alexa 甚至不會是第一個使用 Deepfake 音頻來取代無法親自在場的家庭成員的消費產品。正如Gi z modo指出的那樣,智能音箱Takara Tomy使用人工智能以 父母的聲音給孩子們講睡前故事。據報導,家長可以通過閱讀大約 15 分鐘的劇本來上傳他們的聲音。儘管這與亞馬遜的演示明顯不同,因為產品所有者選擇提供自己的聲音,而不是產品使用可能無法給予他們許可的人的聲音。

除了擔心 Deepfake 被用於詐騙、搶劫和其他邪惡活動之外,亞馬遜如何構建這一功能已經存在一些令人不安的事情,該功能甚至還沒有發布日期。

在展示演示之前,普拉薩德談到了 Alexa 如何為用戶提供“友情關係”。

“在這個友情角色中,同理心和情感的人類品質是建立信任的關鍵,”首席執行官說。“在當前的大流行期間,當我們許多人失去我們所愛的人時,這些屬性變得更加重要。雖然人工智能無法消除這種失去的痛苦,但它絕對可以延長他們的記憶。”

普拉薩德補充說,該功能“提供了持久的個人關係”。

確實,無數人正在認真尋求人類的“同理心和情感”,以應對 COVID-19 大流行造成的情緒壓力。然而,亞馬遜的人工智能語音助手並不能勝任滿足這些人類需求的任務。Alexa 也無法與不再與我們在一起的人提供“長期的個人關係”。

不難相信,這一不斷發展的功能背後有良好的意圖,並且聽到您想念的人的聲音可以帶來極大的安慰。理論上,我們甚至可以享受這樣的功能。讓 Alexa 讓朋友聽起來像是他們說了一些愚蠢的話是無害的。而且,正如我們上面所說,還有其他公司以類似於亞馬遜所展示的方式使用 Deepfake 技術。

但將 Alexa 不斷發展的能力作為與已故家庭成員重新聯繫的方式來呈現是一個巨大的、不切實際的和有問題的飛躍。與此同時,觸動心弦、引發與疫情相關的悲傷和孤獨似乎是徒勞的。有些地方是亞馬遜不屬於的,悲傷諮詢就是其中之一。

發佈留言