У розробці функції Alexa зробить глибоку підробку голосів живих і мертвих

Amazon з’ясовує, як змусити голосового помічника Alexa глибоко підробляти голос будь-кого, мертвого чи живого, лише за допомогою короткого запису. Компанія продемонструвала цю функцію на своїй конференції re:Mars у Лас-Вегасі в середу, використовуючи емоційну травму від триваючої пандемії та горе, щоб викликати інтерес.

Re:Mars від Amazon зосереджується на штучному інтелекті, машинному навчанні, робототехніці та інших нових технологіях, а на сцену виступають технічні експерти та лідери галузі. Під час основної доповіді другого дня Рохіт Прасад, старший віце-президент і головний науковий співробітник Alexa AI в Amazon, продемонстрував функцію, яка зараз розробляється для Alexa.

Під час демонстрації дитина запитує Алексу: «Чи може бабуся дочитати для мене «Чарівника країни Оз»?» Алекса відповідає: «Добре» своїм типовим жіночим голосом робота. Але потім з динаміка лунає голос бабусі дитини, яка читає казку Л. Франка Баума.

Ви можете переглянути демонстрацію нижче:

Прасад лише сказав, що Amazon «працює» над можливостями Alexa, і не уточнив, які роботи ще залишилися, а також коли та чи будуть вони доступні.

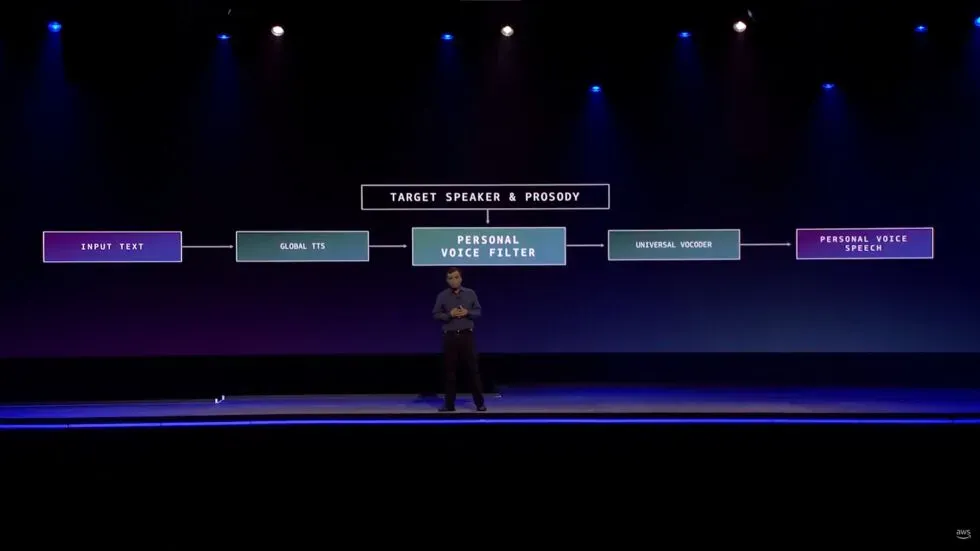

Проте він повідомив найменші технічні деталі.

«Коли ми повинні були навчитися відтворювати високоякісний голос менш ніж за хвилину запису, це вимагало винаходу порівняно з годинами запису в студії», — сказав він. «Ми зробили це можливим, сформулювавши проблему як проблему перетворення голосу, а не як проблему генерування мови».

Звичайно, дипфейки всіх типів зазвичай мають неоднозначну репутацію. Однак робилися деякі спроби використовувати цю технологію як інструмент, а не засіб для створення жахливого стану.

Зокрема, як зазначає The Verge, аудіофейки використовувалися в ЗМІ, щоб компенсувати випадки, скажімо, коли подкастер переплутав рядок або коли зірка проекту раптово померла, як це сталося з документальним фільмом Ентоні Бурдена Roadrunner .

Видання зазначає, що є навіть випадки, коли люди за допомогою штучного інтелекту створюють чат-ботів , які спілкуються так, ніби вони втратили близьких.

Alexa навіть не буде першим споживчим продуктом, який використовує deepfake audio для заміни члена сім’ї, який не може бути присутнім особисто. Розумна колонка Takara Tomy , як зазначає Gi z modo , використовує штучний інтелект, щоб читати дітям казки перед сном голосом батьків. Повідомляється, що батьки завантажують свої голоси, читаючи сценарій приблизно 15 хвилин, так би мовити. Хоча це помітно відрізняється від демонстрації Amazon тим, що власник продукту вирішує надати власний вокал, а не продукт, використовуючи голос людини, яка, ймовірно, не може дати свій дозвіл.

Окрім занепокоєння щодо використання глибоких фейків для шахрайства, пограбувань та інших мерзенних дій, уже є деякі тривожні речі про те, як Amazon створює цю функцію, яка ще навіть не має дати випуску.

Перед тим, як показати демонстрацію, Прасад розповів про те, як Alexa надає користувачам «товариські стосунки».

«У цій ролі товариства людські якості емпатії та афекту є ключовими для побудови довіри», — сказав генеральний директор. «Ці якості стали ще важливішими під час пандемії, яка триває, коли багато хто з нас втратили когось, кого любили. Хоча штучний інтелект не може усунути цей біль втрати, він точно може розширити їх пам’ять».

Прасад додав, що ця функція «забезпечує тривалі особисті стосунки».

Це правда, що незліченна кількість людей серйозно шукає людського «співчуття та афекту» у відповідь на емоційний стрес, спричинений пандемією COVID-19. Однак голосовий помічник Amazon зі штучним інтелектом не в змозі задовольнити ці людські потреби. Alexa також не може забезпечити «довгострокові особисті стосунки» з людьми, яких більше немає з нами.

Неважко повірити, що за цією функцією, що розвивається, стоять добрі наміри, і що почути голос людини, за якою ви сумуєте, може бути великою втіхою. Теоретично ми могли б навіть повеселитися з такою функцією. Змусити Alexa зробити так, щоб друг звучав так, ніби вони сказали, що якась дурниця нешкідлива. І, як ми вже говорили вище, є й інші компанії, які використовують технологію deepfake у спосіб, подібний до того, що продемонстрував Amazon.

Але представлення еволюції здатності Alexa як способу відновити зв’язок із померлими членами сім’ї – це гігантський, нереалістичний і проблематичний стрибок. Тим часом торкатися струн серця, викликаючи сум і самотність, пов’язану з пандемією, здається марною справою. Є місця, куди Amazon не належить, і консультування з приводу горя є одним із них.

Залишити відповідь