Turing-Test auf Steroiden: Crowdsourcing-Bewertungen von Chatbot Arena für 45 KI-Modelle

Dutzende unterschiedlicher Large Language Models (LLMs)vertieften sich inArten von Debattenund gründeten Chatbot Arena

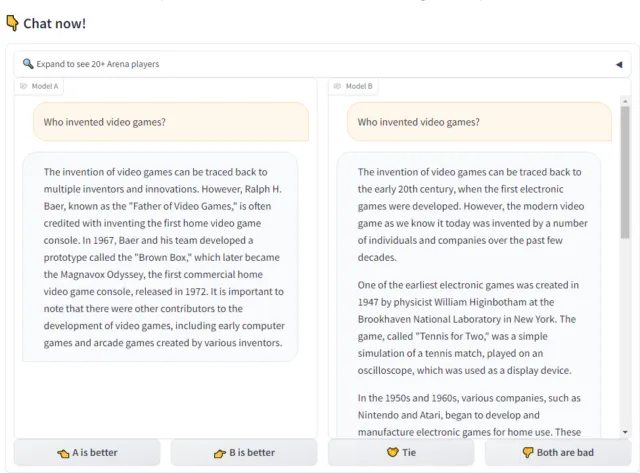

Benutzer der Chatbot Arena können jede Eingabeaufforderung, die ihnen einfällt, in das Formular der Website eingeben, um die Antworten von zwei zufällig ausgewählten Modellen nebeneinander anzuzeigen. Die Identität jedes Modells bleibt zunächst verborgen und die Ergebnisse werden ungültig, wenn das Modell seine Identität in der Antwort selbst preisgibt.

Der Benutzer kann dann auswählen, welches Modell seiner Meinung nach das „bessere“ Ergebnis geliefert hat, mit zusätzlichen Optionen für „Unentschieden“ oder „beide sind schlecht“. Erst nach der Angabe einer paarweisen Rangfolge kann der Benutzer sehen, welche Modelle er hat haben beurteilt, obwohl ein separater „Nebeneinander“-Bereich der Website den Benutzern die Möglichkeit bietet, zwei spezifische Modelle zum Vergleichen auszuwählen (ohne die Möglichkeit, über das Ergebnis abzustimmen).

Seit seiner öffentlichen Einführung im Mai hat LMSys nach eigenen Angaben über 130.000 blinde paarweise Bewertungen für 45 verschiedene Modelle gesammelt (). Stand Anfang Dezember). Diese Zahlen scheinen nach einer kürzlichen positiven Bewertung von Andrej Karpathy von OpenAI, die bereits zu was LMSys geführt hat, schnell zu steigen beschreibt als „einen Super-Stresstest“ für seine Server.

Die Tausenden paarweisen Bewertungen von Chatbot Arena werden durch ein Bradley-Terry-Modell berechnet, das Zufallsstichproben verwendet, um eine Bewertungsschätzung im Elo-Stil zu erstellen Welches Modell wird am ehesten im direkten Wettbewerb gegen ein anderes Modell gewinnen? Interessenten können auch in den Rohdaten Zehntausender menschlicher Prompt-/Response-Bewertungen selbst stöbern oder beobachten Detailliertere Statistiken, wie zum Beispiel direkte paarweise Gewinnraten zwischen Modellen und Konfidenzintervallbereiche für diese Elo-Schätzungen.

Schreibe einen Kommentar