La mise à jour de ChatGPT permet à son IA de « voir, entendre et parler », selon OpenAI

Lundi, OpenAI a annoncé une mise à jour importante de ChatGPT qui permet à ses modèles d’IA GPT-3.5 et GPT-4 d’analyser les images et d’y réagir dans le cadre d’une conversation textuelle. En outre, l’application mobile ChatGPT ajoutera des options de synthèse vocale qui, associées à ses fonctionnalités de reconnaissance vocale existantes, permettront des conversations entièrement verbales avec l’assistant IA, indique OpenAI.

OpenAI prévoit de déployer ces fonctionnalités dans ChatGPT pour les abonnés Plus et Enterprise « au cours des deux prochaines semaines ». Il note également que la synthèse vocale arrive uniquement sur iOS et Android, et que la reconnaissance d’image sera disponible à la fois sur l’interface Web et sur le application mobile.

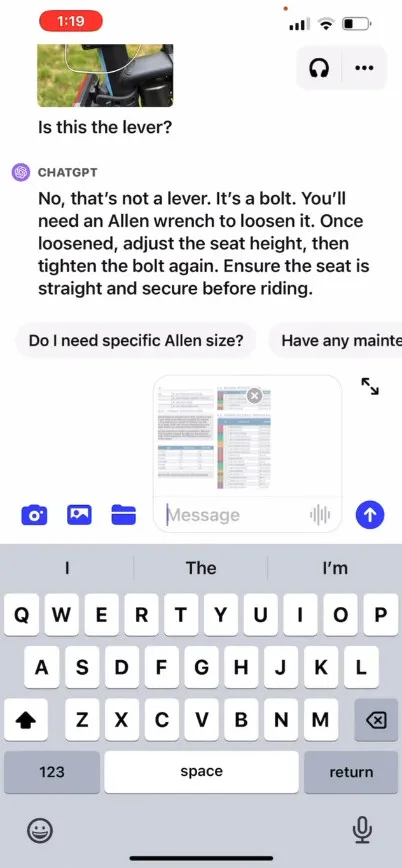

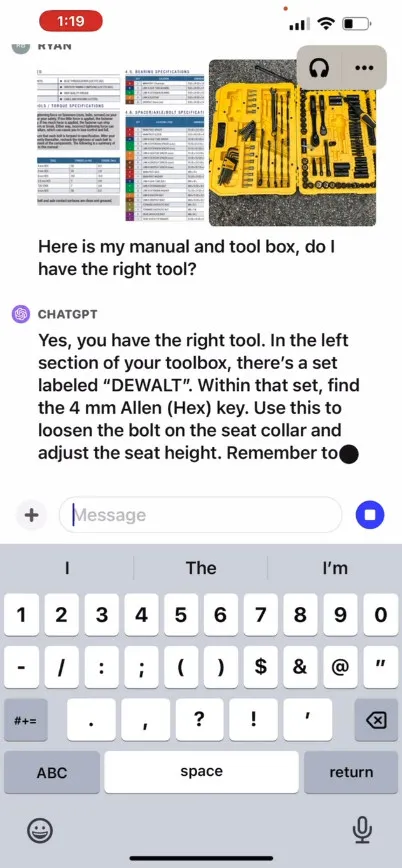

OpenAI indique que la nouvelle fonctionnalité de reconnaissance d’images de ChatGPT permet aux utilisateurs de télécharger une ou plusieurs images pour une conversation, en utilisant les modèles GPT-3.5 ou GPT-4. Dans son article de blog promotionnel , la société affirme que cette fonctionnalité peut être utilisée pour diverses applications quotidiennes : depuis la détermination de ce qu’il y a pour le dîner en prenant des photos du réfrigérateur et du garde-manger, jusqu’au dépannage des raisons pour lesquelles votre gril ne démarre pas. Il indique également que les utilisateurs peuvent utiliser l’écran tactile de leur appareil pour encercler les parties de l’image sur lesquelles ils souhaitent que ChatGPT se concentre.

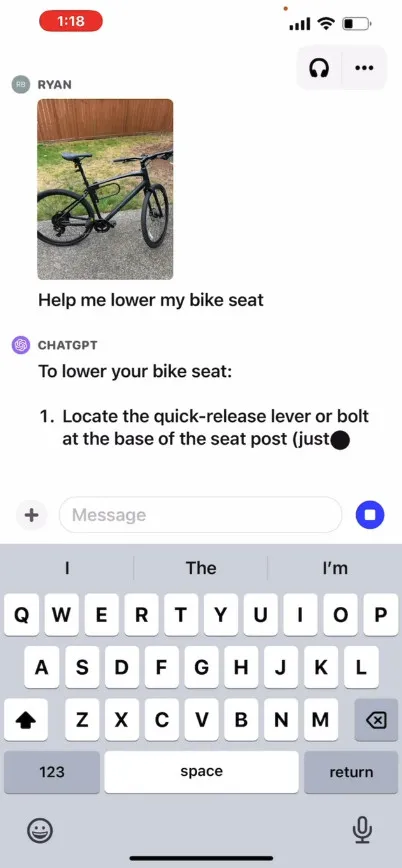

Sur son site, OpenAI propose une vidéo promotionnelle qui illustre un échange hypothétique avec ChatGPT où un utilisateur demande comment surélever un siège de vélo, en fournissant des photos ainsi qu’un manuel d’instructions et une image de la boîte à outils de l’utilisateur. ChatGPT réagit et conseille l’utilisateur sur la manière de terminer le processus. Nous n’avons pas testé cette fonctionnalité nous-mêmes, son efficacité réelle est donc inconnue.

Alors, comment ça marche? OpenAI n’a pas publié de détails techniques sur la façon dont GPT-4 ou sa version multimodale, GPT-4V , fonctionnent sous le capot, mais sur la base de recherches connues sur l’IA menées par d’autres (y compris le partenaire OpenAI Microsoft ), les modèles d’IA multimodaux transforment généralement le texte et les images en un espace de codage partagé, qui leur permet de traiter différents types de données via le même réseau neuronal. OpenAI peut utiliser CLIP pour combler le fossé entre les données visuelles et textuelles de manière à aligner les représentations d’images et de texte dans le même espace latent , une sorte de réseau vectorisé de relations de données. Cette technique pourrait permettre à ChatGPT de faire des déductions contextuelles à travers du texte et des images, bien que cela soit spéculatif de notre part.

Pendant ce temps, dans le domaine audio, la nouvelle fonctionnalité de synthèse vocale de ChatGPT permettrait des conversations orales avec ChatGPT, pilotées par ce qu’OpenAI appelle un « nouveau modèle de synthèse vocale », bien que la synthèse vocale ait été résolue depuis un certain temps. longue durée. Une fois la fonctionnalité déployée, la société affirme que les utilisateurs peuvent l’utiliser en acceptant les conversations vocales dans les paramètres de l’application, puis en sélectionnant parmi cinq voix synthétiques différentes avec des noms tels que « Juniper », « Sky », « Cove », « Ember ». » et » Breeze « . OpenAI affirme que ces voix ont été créées en collaboration avec des comédiens professionnels.

Whisper d’OpenAI, un système de reconnaissance vocale open source dont nous avons parlé en septembre de l’année dernière, continuera à gérer la transcription des entrées vocales des utilisateurs. Whisper a été intégré à l’ application iOS ChatGPT depuis son lancement en mai. OpenAI a publié l’ application Android ChatGPT aux capacités similaires en juillet.

Laisser un commentaire