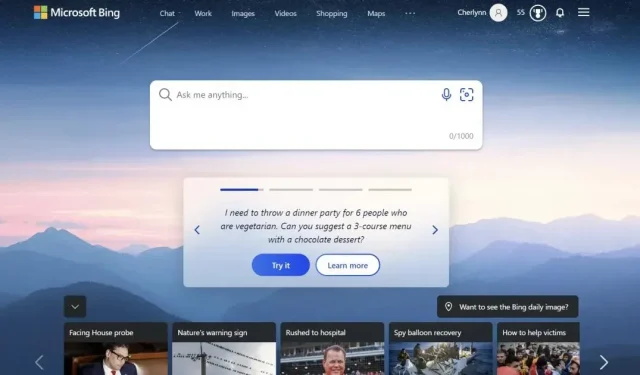

Microsoft ļauj personalizēt ar AI darbinātu Bing tērzēšanas robotu

Microsoft pievieno identitātes kontroli savam AI tērzēšanas robotam pakalpojumam Bing, lai pievienotu arī papildu drošības līmeni lietošanai.

Microsoft ātri izpildīja savu solījumu nodrošināt lietotājiem lielāku kontroli pār Bing iebūvētā mākslīgā intelekta personību . Tīmekļa pakalpojumu direktors Mihails Parahins sacīja, ka 90% Bing testētāju tagad vajadzētu redzēt iespēju mainīt tērzēšanas robotu atbildes. Opcija “Radošs” ļauj algoritmam būt “oriģinālākam un radošākam”, citiem vārdiem sakot, “jautrākam”, savukārt opcija “Precīza” liek uzsvaru uz skaidrām, izteiksmīgām un precīzām atbildēm. Ir arī starpposma opcija “Līdzsvarots”.

Microsoft pievieno personīgo kontroli savam AI tērzēšanas robotam vietnē Bing

Tiek ziņots, ka Redmondā bāzētajam uzņēmumam izdevās ierobežot Bing AI atbildes pēc tam, kad agrīnie testētāji pamanīja dažkārt dīvainu, pat satraucošu uzvedību garu sarunu un citu “izklaides” sesiju laikā. Kā atzīmē The Verge, šie ierobežojumi kaitina dažus lietotājus, jo dažreiz tērzēšanas robots vienkārši atsakās atbildēt uz jautājumiem. Kopš tā laika Microsoft ir pakāpeniski atcēlusi šos ierobežojumus, un pirms dažām dienām amerikāņu gigants atjaunināja savu mākslīgo intelektu, lai samazinātu šo vājumu, no vienas puses, un “halucinācijas” – šīs novirzes, no otras puses. Tātad tērzēšanas robots, iespējams, vairs nebūs tik skaisti dīvains, taču tam vajadzētu būt vairāk tendētam apmierināt jūsu zinātkāri.

Tas arī pievieno papildu drošības līmeni lietošanas laikā

Šī personības opcija parādās, kad Microsoft paplašina piekļuvi savam Bing AI. Uzņēmums jau februāra beigās integrēja tehnoloģiju savās mobilajās un Skype lietotnēs, un pirms dažām dienām tas padarīja funkcionalitāti pieejamu, izmantojot Windows 11 uzdevumjoslu. Šī elastība varētu padarīt informāciju vēl noderīgāku šajās daudzveidīgākajās vidēs un pievienot papildu drošības līmeni, jo arvien vairāk lietotāju katru dienu izmēģina šo jauno funkciju. Izvēloties opciju “Radošs”, sapratīsit, ka nevar pilnībā uzticēties robota radītajiem rezultātiem.

Atbildēt