Штучний інтелект тепер може створювати музику CD-якості з тексту, і це стає лише краще

Уявіть, що ви набираєте «драматичну вступну музику» і чуєте високу симфонію або пишете «моторошні кроки» та отримуєте високоякісні звукові ефекти. Це обіцянка Stable Audio, моделі штучного інтелекту перетворення тексту в аудіо, анонсованої в середу компанією Stability AI, яка може синтезувати музику або звуки з письмових описів. Невдовзі подібна технологія може поставити під сумнів роботу музикантів.

Якщо ви пам’ятаєте, Stability AI – це компанія, яка допомогла профінансувати створення Stable Diffusion , моделі синтезу зображення прихованої дифузії, випущеної в серпні 2022 року. Не обмежившись лише створенням зображень, компанія розгалужилася на аудіо, підтримавши Harmonai , лабораторія ШІ, яка запустила музичний генератор Dance Diffusion у вересні.

Тепер Stability та Harmonai хочуть увірватися в комерційне виробництво аудіо штучного інтелекту за допомогою Stable Audio. Судячи з виробничих зразків , це схоже на значне покращення якості звуку порівняно з попередніми аудіогенераторами AI, які ми бачили.

На своїй рекламній сторінці Stability надає приклади моделі штучного інтелекту в дії з такими підказками, як «епічна трейлерна музика, інтенсивна племінна перкусія та духові» та «lofi hip hop beat melodic chillhop 85 bpm». Він також пропонує зразки звукових ефектів, створених за допомогою Stable Audio. , як-от пілот авіакомпанії, що розмовляє через домофон, або люди, які розмовляють у жвавому ресторані.

Щоб навчити свою модель, Stability співпрацює з музичним провайдером AudioSparx і ліцензує набір даних, який «складається з понад 800 000 аудіофайлів, що містять музику, звукові ефекти та елементи для одного інструменту, а також відповідні текстові метадані». Після подачі 19 500 годин аудіо. У модель Stable Audio знає, як імітувати певні звуки, які він почув за командою, оскільки звуки були пов’язані з їх текстовими описами в його нейронній мережі.

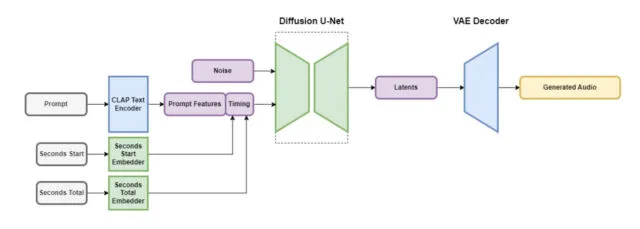

Stable Audio містить кілька частин, які працюють разом, щоб швидко створювати персоналізований звук. Одна частина зменшує аудіофайл таким чином, що зберігає його важливі функції, видаляючи непотрібні шуми. Це робить систему як швидшою для навчання, так і для створення нового аудіо. Інша частина використовує текст (метадані опису музики та звуків), щоб визначити, який тип аудіо генерується.

Щоб пришвидшити роботу, архітектура стабільного аудіо працює на сильно спрощеному, стисненому представленні аудіо, щоб зменшити час висновку (кількість часу, який потрібен моделі машинного навчання для генерування виходу після того, як їй надано вхід). За даними Stability AI, Stable Audio може відтворювати 95 секунд стереоаудіо з частотою дискретизації 44,1 кГц (часто називається «якістю компакт-диска») менш ніж за одну секунду на графічному процесорі Nvidia A100 . A100 — це потужний графічний процесор для центру обробки даних, розроблений для використання штучного інтелекту, і він набагато потужніший, ніж звичайний графічний процесор для настільних ігор.

Як уже згадувалося, Stable Audio — не перший музичний генератор, заснований на методах прихованої дифузії. У грудні минулого року ми розповідали про Riffusion , аудіоверсію Stable Diffusion для любителів, хоча її отримані покоління були далекі від зразків Stable Audio за якістю. У січні Google випустив MusicLM , музичний генератор штучного інтелекту для звуку 24 кГц, а Meta запустила набір аудіоінструментів з відкритим кодом (включаючи генератор тексту в музику) під назвою AudioCraft у серпні. Тепер, зі стереозвуком 44,1 кГц, Stable Diffusion підвищує ставку.

Стабільність каже, що Stable Audio буде доступний у безкоштовному рівні та плані Pro за 12 доларів на місяць. Завдяки безкоштовному варіанту користувачі можуть створювати до 20 треків на місяць, кожна з яких має максимальну тривалість 20 секунд. План Pro розширює ці обмеження, дозволяючи створювати 500 треків на місяць і довжиною до 90 секунд. Очікується, що майбутні випуски Stability включатимуть моделі з відкритим кодом на основі архітектури Stable Audio, а також навчальний код для тих, хто зацікавлений у розробці моделей генерації аудіо.

У поточному стані схоже, що ми можемо бути на межі виробництва якісної музики, створеної штучним інтелектом, зі стабільним аудіо, враховуючи його точність звуку. Чи будуть музиканти щасливі, якщо їх замінять моделі ШІ? Швидше за все, ні, якщо історія показала нам щось із протестів ШІ у сфері образотворчого мистецтва . На даний момент людина може легко перевершити все, що може створити штучний інтелект, але це може бути недовго. У будь-якому випадку аудіо, згенероване штучним інтелектом, може стати ще одним інструментом у наборі інструментів аудіопродукції професіонала.

Залишити відповідь